Por Marc Eliot Stein, World BEYOND War, 31 de julho de 2023

Esta é uma transcrição completa do Episódio 50 de World BEYOND War: um novo podcast.

É julho, o verão quente de 2023. Você sabe quem eu sou, sou Marc Eliot Stein, diretor de tecnologia da World Beyond War, ainda aqui nas terras Lanape do Brooklyn em Nova York, ainda fazendo a coisa certa aqui no World Beyond War Podcast, Exceto que hoje é especial porque este é o episódio 50, uau, um número redondo.

Quando comecei este podcast, acho que nunca pensei se chegaria ou não a 50 episódios. O número 50 com certeza não teria parecido realista na época. Acho que estava me perguntando principalmente se algum dia terminaria o episódio número 1, e houve algumas tentativas de desistir antes de fazê-lo.

E aqui estou eu aos 50 anos, e que alegria é perceber que descobrimos como fazer esse podcast antiguerra realmente funcionar e encontramos um público que cresce a cada mês. Estou muito orgulhoso deste podcast e sou grato a todos que fizeram parte dele até agora.

Podcasting é um formato criativo único. Não é como qualquer outra coisa. Eu sei disso porque também sou um viciado em podcast. Tenho pelo menos 20 programas regulares com os quais realmente me importo - sobre história, política, tecnologia, música, literatura, TV, filmes. Quando estou com vontade de relaxar e expandir meu conhecimento ao mesmo tempo, realmente não há outro formato que chegue como um podcast. Acho que essa é uma distinção importante: coloque um apresentador e um convidado em um webinar, digamos, ou em um bate-papo transmitido ao vivo, e eles terão um tipo de conversa, mas se você colocar as mesmas duas pessoas em uma entrevista em podcast, de alguma forma eles Terá um tipo diferente de conversa – provavelmente mais pessoal, mais espontânea, mais divagante, mais no momento, menos projetada para chegar a uma conclusão.

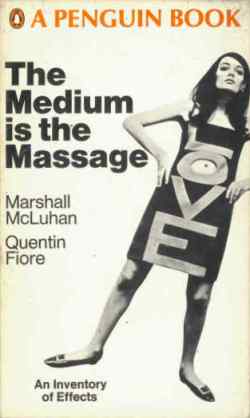

Por que isso exatamente? Não sei, mas o falecido filósofo da mídia e tecnologia Marshall McLuhan escreveu algo em 1964 sobre a rapidez com que a nova popularidade da televisão estava mudando a sociedade moderna, e ele estava certo. O meio, disse McLuhan, é a mensagem. O formato é o conteúdo.

Por exemplo, você pode escrever as mesmas palavras no Facebook, no Twitter e no LinkedIn, e as palavras terão um significado particular diferente em cada caso. Uma vez que os podcasts celebram a voz humana espontânea e não ensaiada, o podcasting tornou-se um fórum onde a ambivalência humana ou mesmo a contradição e a ironia desconcertantes podem ser facilmente bem-vindas e compreendidas. Acho que este é um bom fórum para falar sobre uma tendência que está muito nos noticiários e que tenho muitos pensamentos ambivalentes e perplexos para compartilhar com vocês hoje. Estou falando de inteligência artificial.

Quando Marshall McLuhan disse que o meio é a mensagem em 1964, quando poucas pessoas pensavam sobre as maneiras sutis como a televisão e outras mídias domésticas de transmissão íntima estavam mudando a própria estrutura da sociedade humana. Hoje, um novo meio possibilitado pela tecnologia mais atual também ameaça ter um grande impacto social. Estou falando de ferramentas populares de IA de uso geral, como o ChatGPT, que estão disponíveis para qualquer pessoa com conexão à Internet - e se você ainda não ouviu falar do ChatGPT, está recebendo muita atenção em todos os lugares por causa de como ele emula a conversa humana. e com que facilidade ele pode integrar e recuperar todo o amplo espectro de conhecimento geral disponível.

Os chatbots existem há alguns anos – eles podem ser tão simples e inócuos quanto chatbots de atendimento ao cliente automatizados e amigáveis em um site da BestBuy ou Ticketmaster. Novos chatbots, como o ChatGPT4, não se limitam a produtos eletrônicos ou ingressos para shows – são tipos muito diferentes de mecanismos de conhecimento, conhecidos como modelos de linguagem ampla, treinados para compreender a totalidade da inteligência humana.

Às vezes, as pessoas pensam que o G no ChatGPT é para Geral, e isso seria um palpite decente, porque o sistema foi projetado para demonstrar inteligência geral e conhecimento geral. O G na verdade significa Generative, o que significa que este produto também foi projetado para criar coisas – para gerar imagens e palavras originais. O P significa pré-treinado, sobre o qual falaremos em alguns minutos, e o T é Transformer, que não é um álbum clássico de Lou Reed, mas um padrão de design de software que permite que o modelo de linguagem responda a textos inseridos não por processando uma palavra por vez, mas considerando e executando transformações em todo o texto inserido como um todo.

Esses novos chatbots podem conversar sobre qualquer tópico em um estilo de conversa amigável, interpessoal e diferenciado. Os chatbots podem escrever redações, resolver problemas, fazer pesquisas profundas em bancos de dados, gerar código de computador e responder instantaneamente a perguntas difíceis. O ChatGPT e outras ofertas semelhantes mostram um nível de agilidade linguística e abrangente que parece mover o campo da inteligência artificial mais rápido do que muitos de nós esperávamos. Houve uma notícia não muito tempo atrás de que alguns funcionários do Google acreditavam que seu próprio sistema de IA poderia passar no teste de Turing e se tornar indistinguível da comunicação humana senciente, assustando os próprios especialistas do Google com sua evidência de consciência. Não sei se pessoalmente acredito que qualquer IA possa passar no Teste de Turing, mas sei que muitos especialistas agora acreditam que isso está se tornando possível.

Os chatbots de conhecimento geral estão longe de ser o único caso de uso popular para IA. Os geradores de imagens podem criar instantaneamente obras de arte visuais a partir de prompts de texto – às vezes imagens surpreendentes e inteligentes que levariam horas, dias ou semanas para os pintores físicos ou artistas digitais criarem. A geração de imagens a partir de prompts de texto é uma realidade hoje por meio de geradores online gratuitos de imagens de inteligência artificial como o DALL-E, da OpenAI, mesma empresa do Vale do Silício que criou o ChatGPT. Você pode imaginar uma ideia e descrever um estilo de pintura e este serviço da web envia magicamente várias variações diferentes de tentativas para capturar sua ideia.

Isso é uma realidade hoje, e também é uma realidade hoje que o ChatGPT4 pode escrever redações proficientes, ponderadas e extensas sobre quase todos os tópicos sobre os quais são questionados - redações que podem ser boas o suficiente para obter diplomas universitários avançados.

Talvez seja muito cedo para fazer uma previsão como essa, mas parece que chatbots inteligentes e geradores de imagens – escrita e arte geradas por máquinas – representam uma grande inovação tecnológica e uma grande inovação social que afetará todos nós na Terra de uma maneira ou outro. Quem sabe para que lado o futuro está indo hoje em dia, mas parece pelo menos possível que o lançamento do ChatGPT3 em 2022 seja um dia lembrado um momento significativo na história cultural semelhante ao lançamento do navegador Mosaic em 1993, que deu início a todo o popular O boom da Internet em que ainda vivemos hoje.

Também parece possível, fico perturbado em dizer, que essa nova inovação causará novos tipos de problemas importantes com os quais todos teremos de lidar, mesmo que muitos de nós sintamos que nossa sociedade já está se afogando nos indesejados efeitos posteriores da outras inovações tecnológicas que não solicitamos em nossas vidas, não convidamos para nossas vidas e, no entanto, estão em nossas vidas de qualquer maneira.

Quero passar este episódio falando sobre como a IA nos afeta como ativistas antiguerra. Deixe-me dizer isso de cara: a IA é um assunto polêmico, muito controverso, e é assim que deve ser. Devemos nos preocupar com isso e devemos falar sobre isso e, na minha opinião, também devemos abrir nossas mentes para o bem que essa tecnologia pode fazer.

É controverso entre progressistas e ativistas e é controverso para todos. Deve ser controverso, e não estou fazendo este episódio porque tenho respostas fáceis sobre como essas inovações recentes podem impactar nosso planeta. Sei que eles afetarão nosso mundo e sei que os ativistas antiguerra precisam falar sobre isso. Então, estou fazendo este episódio para iniciar a conversa, para expor as várias questões diferentes com as quais acho que muitos ativistas antiguerra provavelmente estão lutando quando falam sobre esse tópico e talvez para expressar algum entendimento de todos os lados desse desconcertante problemas. É isso que tentarei fazer aqui – e quando terminar de ouvir este episódio, por favor, compartilhe seus comentários em nosso world beyond war página da web para este episódio, ou entrando em contato comigo diretamente - sou fácil de encontrar.

Em termos de impacto na vida cotidiana, muitos se perguntam se as incríveis capacidades da inteligência artificial vão deixar muitas pessoas desempregadas. Essa costuma ser a primeira preocupação que ocorre às pessoas quando veem o poder da IA. Essas capacidades avançadas farão com que vários setores de emprego humano saudável e se esforcem para se tornar repentinamente indesejados? Nossa sociedade já está muito desequilibrada em termos de quem trabalha, quem ganha e quem gasta. Se os ecossistemas de classe média que trabalham para ganhar a vida forem ainda mais afetados porque a IA pode fazer muitas das mesmas tarefas melhor e de graça, podemos ter certeza de que a interrupção aumentará a divisão entre os ricos e o resto de nós, que o 1 % será capaz de se beneficiar da mudança enquanto o resto de nós enfrentará as consequências, e que o 1% também fará ferramentas de IA que ajudem o 1% indisponíveis para as pessoas que poderiam usar sua ajuda, ou muito caras para eles acessem.

Vamos enfrentá-lo, nas economias capitalistas predatórias em que muitos de nós estamos presos, o desemprego significa contrair dívidas e perder nossa liberdade de escolha, e é exatamente isso que essas economias de fortaleza sociopatas são projetadas para fazer com as pessoas comuns - tirar nosso poder de escolha e nos fazem pagá-los e trabalhar para eles. Esta é a visão futura do capitalismo de fortaleza hoje: teremos novos computadores inteligentes e poderosos, já que nós mesmos estamos empobrecidos.

Há também o fato de que policiais e militares já estão começando a usar ferramentas de inteligência artificial, juntamente com novos robôs violentos e poderosos. Acho que essa pode ser a ameaça mais séria e imediata que a IA apresenta no momento, e acho que os movimentos de protesto sitiados pela polícia, como, digamos, o importante movimento Stop Cop City em Atlanta, Geórgia, já estão lidando com essa realidade alterada. Os sistemas de IA carregam os preconceitos e valores codificados de seus criadores humanos, então policiais ou militares treinados em IA ameaçam se tornar literalmente máquinas de caça e morte para populações vulneráveis, escolhendo seus alvos com base na aparência ou raça. Em um mundo que já está fora de controle com a guerra da Ucrânia ao Iêmen, a ideia de fortalecer um lado ou outro – e, inevitavelmente, ambos os lados – com novos tipos de máquinas assassinas e regimes de repressão codificados com perfis raciais cruéis é tão horrível quanto soa.

Os piores cenários de desemprego em massa ou inteligência artificial codificada racialmente sendo usada por forças policiais e militares são horríveis, e não podemos dormir sobre isso porque os efeitos já estão em nosso mundo. Já está acontecendo. Então, vamos começar esta conversa reconhecendo que dois dos horrores separados que a IA avançada parece apresentar – desemprego em massa e abuso por parte das forças policiais e militares – são duas maneiras diferentes pelas quais forças poderosas de riqueza e privilégio entrincheirados roubam direitos e liberdades das pessoas. .

Falando em riqueza e privilégio arraigados - vamos falar sobre a OpenAI, uma empresa no norte da Califórnia que você pode encontrar online em OpenAI.com. Esta empresa era pouco conhecida até lançar o gerador de imagens DALL-E em 2021 e, em novembro de 2022, apenas nove meses atrás, eles lançaram seu primeiro chatbot público, ChatGPT3, seguido rapidamente pelos mais poderosos e capazes ChatGPT3.5 e ChatGPT4 , as versões disponíveis agora.

Fiquei bastante impressionado quando vi pela primeira vez as imagens que o DALL-E poderia criar e fiquei ainda mais impressionado na primeira vez que experimentei o ChatGPT. O desafio que essas ferramentas estavam tentando enfrentar era muito familiar para mim, porque eu mesmo estudei intensivamente a IA, como muitos desenvolvedores de software. Meu primeiro encontro com a inteligência artificial foi um projeto de estudo independente que fiz na faculdade, algumas décadas atrás.

Isso foi na década de 1980, e talvez alguns muito jovens fiquem surpresos ao saber que pessoas como eu estavam trabalhando com IA na década de 1980, mas o termo inteligência artificial é quase tão antigo quanto a própria revolução do computador. Mesmo que as conquistas da IA das décadas de 1950 a 1990 fossem infantis em comparação com os avanços que vimos nos anos desde então.

Na verdade, o campo era tão aberto nos anos 80 que consegui alguns créditos durante meu último ano como estudante combinado de Filosofia e Ciência da Computação, elaborando um projeto original de estudo independente para um programa que analisaria frases em inglês e responda de uma forma que demonstre ou simule a compreensão básica. Eu codifiquei em LISP em um terminal Unimatic hilário e volumoso com brilho verde conectado a um enorme mainframe Univac que era do tamanho de um prédio grande e provavelmente tinha menos energia do que o MacBook no qual estou gravando este podcast agora, porque é assim que rolamos lá nos anos 80.

O desafio empolgante do meu projeto de estudo independente de IA era analisar e responder a frases que incluíam verbos e substantivos simples. Por exemplo, eu digitaria frases como “Eu tenho um gato chamado Happy” e “meu gato é laranja” e “todos os gatos dizem miau” em meu programa LISP, o que demonstraria alguma compreensão respondendo a perguntas como “Happy is orange?” ou “o gato de Marc diz miau?”. Curiosamente, eu estava tentando criar um chatbot de IA ali mesmo no meu mainframe Univac.

Aposto que muitos outros estudantes universitários estavam tentando fazer a mesma coisa na época, mas nenhum de nós foi muito longe, porque estávamos na década de 1980 e uma ideia brilhante ainda não havia chegado até nós: a rede neural, que fornece um software estrutura projetada para realizar operações simples massivamente paralelas semelhantes aos neurônios no cérebro humano. Enquanto meu programa LISP fornecia computação de encadeamento único e os programas Fortran, COBOL e Pascal seguiam o mesmo paradigma limitado de encadeamento único, as redes neurais forneciam encadeamentos elementares paralelos que realizavam cálculos simples em paralelo. O cérebro humano faz um monte de processamento paralelo – operações simultâneas em cascata para formar ilusões de singularidade – e a estrutura de software conhecida como rede neural permitiria aos codificadores colher o poder desse processamento paralelo – depois que me formei na faculdade.

Junto com o conceito de rede neural acabou surgindo o conceito de treinar uma rede neural com atividades repetitivas – outro conceito que ainda não havia chegado até nós na década de 80. Eu estava alimentando meu programa LISP com um pequeno número de sentenças completas e não estava dando nenhum feedback para corrigir e melhorar seu desempenho. O que eu deveria estar fazendo, em vez de digitar frases em meu terminal de computador, era alimentá-lo com livros, jornais e enciclopédias inteiros e interagir constantemente com ele para fornecer feedback sobre seu comportamento enquanto meu programa repetidamente tentava simular os atos mais básicos e primitivos. de compreensão. Ao fornecer muito material de leitura para construir uma base de conhecimento rica e complexa e treiná-la repetitiva e minuciosamente, eu poderia realmente ter feito meu programa de computador dizer algo surpreendente sobre se eu tinha ou não um gato laranja. As redes neurais e o treinamento repetitivo ajudaram a abrir caminho para as simulações bem-sucedidas da inteligência humana que vemos hoje com os chatbots.

Você notará que falo em simular a inteligência humana. Isso aponta para outra controvérsia. Algumas pessoas acham o termo “inteligência artificial” ridículo. Pior do que ridículo, alguns acham a ideia eticamente problemática porque, se a inteligência dá origem à consciência, a inteligência artificial pode se transformar em consciência artificial – senciência artificial, obstinação artificial, direito artificial de existir. Isso com certeza levanta muitas questões existenciais. Todas essas perguntas são válidas e importantes. Alguns se perguntam se os mecanismos de conhecimento da IA e os modelos de linguagem já podem estar desenvolvendo a consciência. Pessoalmente, acho muito fácil declarar que não, não precisamos nos preocupar com chatbots desenvolvendo sentimentos reais. Há muitos aspectos diferentes da IA com os quais me preocupar, e esse não é o que me preocupa pessoalmente. Mas isso não significa que posso provar que estou certo e que ninguém deve se preocupar com isso. Talvez eu esteja tão sobrecarregado com coisas diferentes com as quais eu deveria me preocupar que não tenho tempo para me preocupar com isso. Não tenho uma resposta definitiva para todas as perguntas que podem surgir sobre as questões da sensibilidade da máquina e não vou fingir que tenho. Mas eu sei quais são as questões que precisamos descobrir como confrontar.

Uma opinião que às vezes ouço nas comunidades de ativistas é que a IA representa um monte de exagero – uma ilusão fomentada pelas excelentes habilidades de conversação de um grande modelo de linguagem. Claro, o GPT pode analisar uma pergunta e responder com uma fraseologia elegante, mas por que essa felicidade com a linguagem nos faria imaginar que algum avanço significativo foi feito? O Google e a Wikipédia já tornaram todo o conhecimento humano facilmente disponível gratuitamente na Internet, para consternação da Enciclopédia Britânica. Estamos ouvindo todo esse hype sobre o ChatGPT simplesmente porque ele apresenta uma fachada linguística da consciência humana, uma ilusão pela qual todos nós caímos tão ansiosamente. Eu acho que há alguma validade aqui. Talvez se o Google ou a Wikipedia tivessem sido originalmente lançados da maneira repentina e totalmente formada que o ChatGPT fez, talvez estivéssemos falando sobre o lançamento do Google ou da Wikipedia como grandes avanços na inteligência humana coletiva, porque ambos já impactaram nosso mundo.

Ainda assim, como mencionei acima quando falei sobre redes neurais e treinamento, descrever grandes modelos de linguagem como fachadas é subestimar as camadas de estrutura de software que devem existir para tornar possível essa felicidade linguística.

Aqui está uma questão maior, na minha opinião: vamos examinar a ética da OpenAI e de seus diretores, fundadores, investidores e parceiros. Há um monte de problemas aqui.

O OpenAI.com é um laboratório de pesquisa com financiamento privado que emerge do mesmo ecossistema de incubadoras de tecnologia do Vale do Silício ultra-rico e de alto desempenho que nos deu Facebook, Google, Microsoft, Amazon e Oracle. Seus fundadores incluem Elon Musk, o bilionário famoso cujos comentários públicos sociopatas realmente me enojam tanto quanto enojam muitas outras pessoas. Elon Musk nunca esteve diretamente envolvido na OpenAI e passou a fazer outras coisas, como exibir sua personalidade ofensiva em todas as mídias sociais, então é tudo o que quero dizer sobre Elon Musk hoje.

A meu ver, é ainda mais condenável que a OpenAI esteja fortemente envolvida com a Microsoft, uma grande aproveitadora de guerra e uma grande aproveitadora no campo da inteligência artificial para a guerra. Espero que as pessoas se preocupem com essa associação preocupante, ainda mais do que com a conexão de Elon Musk. Devemos ficar muito perturbados com o fato de que a face amigável do DALL-E e da OpenAI é uma fachada útil para pelo menos um explorador de guerra extremamente influente e maligno, a Microsoft, que já está desenvolvendo os tipos de aplicativos de inteligência artificial militar e policial com códigos raciais de que falamos. sobre acima. Isso já está acontecendo nos bastidores da Microsoft e de outros gigantes da tecnologia dos EUA que estão profundamente ligados à máquina de guerra dos EUA. E esta é a pior notícia que posso imaginar.

Nós do movimento antiguerra não podemos virar as costas para a inteligência artificial por causa de seu potencial maligno. Não quero dizer, é claro, que todos no movimento antiguerra precisam permitir intromissões tecnológicas em suas próprias vidas. Fico feliz que muitos progressistas e ativistas façam uma escolha válida para evitar as inovações tecnológicas da moda em suas vidas. Posso me relacionar e respeitar essa atitude, embora eu esteja longe de ter um estilo de vida livre de tecnologia. Tecnologia é meu campo, minha carreira e, como tecnólogo, sou fascinado pela genialidade, criatividade e inovação por trás de empreendimentos como a inteligência artificial.

Além disso, simplesmente como uma pessoa curiosa, estou absolutamente interessado em obter insights sobre a inteligência humana aprendendo sobre como os computadores foram feitos para simulá-la. Eu também permito que o ChatGPT entre na minha vida porque descobri como ele é útil. Vou ao OpenAI.com e faço perguntas constantemente. Eu uso o ChatGPT para escrever código, incluindo Javascript para uma nova versão do nosso mapa interativo das bases militares estrangeiras dos EUA, no qual estou trabalhando neste verão junto com outras pessoas em World Beyond War.

Digamos que eu queira limpar um parâmetro de string de consulta removendo caracteres especiais com uma expressão regular, algo que eu teria usado para perguntar ao Stack Overflow, e juntaria meu código de trabalho a partir de fragmentos recomendados postados em um tópico de conversa . Em vez disso, agora digo ao ChatGPT o que quero, e o ChatGPT simplesmente apresenta Javascript perfeitamente formatado, executável e sem erros. A maioria dos meus amigos desenvolvedores de software usa o ChatGPT para escrever código agora – eu sei que usamos porque gostamos de falar sobre isso. Acho que nenhum de nós, programadores, está preocupado com a possibilidade de o ChatGPT nos substituir, porque somos nós que temos que juntar os pedaços de código para criar sistemas funcionais, e o GPT está apenas produzindo pedaços de código. Mas eu me pergunto como isso mudará a maneira como os desenvolvedores de software trabalham. Com certeza já está mudando o jogo.

Também uso o ChatGPT para pesquisar coisas on-line da mesma forma que usaria para usar o Google, e o uso para prompts, perspectivas e informações básicas sobre coisas sobre as quais estou escrevendo ou pensando. Não estou brincando quando digo que uso para tudo – como quando mencionei o filósofo da tecnologia dos anos 1960 Marshall McLuhan acima, é claro que pedi ao ChatGPT algumas informações sobre Marshall McLuhan, e foi o ChatGPT quem me disse que 1964 foi o ano em que ele publicou o livro que dizia “o meio é a mensagem”.

O fato de muitos de nós já termos migrado do Google para o GPT para pesquisas básicas na Internet diz muito. É muito fácil começar a permitir que esses novos tipos de ferramentas entrem lenta e imperceptivelmente em nossas vidas, mesmo quando nos preocupamos com as implicações e motivações por trás delas.

Como a tecnologia de software subjacente da própria Internet, que foi criada por razões duvidosas pelos militares dos EUA, mas acabou causando mudanças sociais e encontrando novos casos de uso que estavam completamente fora do domínio de seu propósito original, essa nova tecnologia vai encontrar seu próprio caminho para impactar nossas vidas. Essa nova tecnologia é real, funciona bem demais para ser ignorada e veio para ficar. Novamente, é por isso que estou gastando um episódio conversando com ativistas antiguerra sobre isso – porque já faz parte de nossa realidade e podemos precisar de alguns dos poderes que ela oferece para realizar nosso próprio trabalho aqui na Terra.

Vamos passar um minuto ponderando sobre os muitos aspectos da vida neste planeta que não têm os terríveis problemas dos quais nós, ativistas antiguerra, estamos tão cientes. Artes, música, literatura, biologia, química, física, geologia, astronomia, medicina, saúde, manufatura, agricultura, nutrição. Em todos esses mundos, todos esses empreendimentos… o lançamento público de um chatbot de conhecimento geral altamente capaz está tendo um grande impacto. Não há campo que não toque.

No plano da coexistência humana pacífica – um plano que eu gostaria de passar mais tempo existindo em mim mesmo – a inteligência artificial é um avanço milagroso da capacidade humana que promete grandes benefícios. Se ao menos vivêssemos em um mundo pacífico, seguro e igualitário, poderíamos aproveitar melhor juntos as maravilhas que a inteligência artificial pode produzir.

Vemos algumas dessas maravilhas quando trabalhamos com um gerador de imagens e criamos imagens incrivelmente inteligentes ou criativas com base em nossos próprios prompts que não poderíamos produzir de outra forma. Também sentimos o paradoxo sobre se as ferramentas de inteligência artificial podem ou não ser usadas para o bem. Como técnico, acredito que não é a inovação tecnológica que é o problema do planeta Terra no século XXI. Eu sempre acolho a inovação tecnológica e acho que os perigos que a IA apresenta se devem ao capitalismo arraigado e à guerra – ao fato de que este é um planeta em guerra consigo mesmo, um planeta dominado por um 21% rico que não consegue resistir a colocar-se em o caminho suicida de construir sociedades-fortalezas militarizadas que oprimem outros seres humanos para manter privilégios. O que precisamos é curar nossa sociedade – o que não precisamos é fugir dos avanços tecnológicos porque entendemos mal as causas de nossa agonia e nossa trajetória suicida.

Isso é o que eu acho. Claro que não é o que todo ativista antiguerra pensa, e tudo bem. Tivemos algumas reações interessantes no World Beyond War lista de discussão por e-mail – que é um fórum animado e inteligente que recomendo a todos que participem, basta clicar no link em nosso site ou procurar por world beyond war lista de discussão – depois que alguém compartilhou algumas imagens antiguerra realmente imaginativas que foram geradas com o DALL-E, e outra pessoa compartilhou algumas palavras surpreendentemente úteis sobre como nosso planeta doente pode encontrar caminhos para a paz mundial.

Acredito que os ativistas devem dominar todas as tecnologias disponíveis – que o ativismo não deve se colocar na posição de ser menos capaz de usar tecnologias inovadoras avançadas do que os governos corruptos e as corporações gananciosas que costumam nos oprimir.

Também acredito que podemos coletar verdades filosóficas surpreendentes sobre a consciência humana e a existência humana estudando os algoritmos e padrões de design usados para modelá-los e simulá-los. Passar apenas alguns minutos brincando com o ChatGPT no site da OpenAI pode revelar algumas verdades malucas sobre a natureza humana.

Aqui está uma coisa selvagem que ainda estou envolvendo meu cérebro. O ChatGPT às vezes mente. Isso inventa coisas. Normalmente, você não verá isso quando começar a questionar o GPT, porque ele geralmente apresentará uma resposta poderosa para a primeira pergunta em um tópico de conversa. O GPT então acompanha você enquanto você faz perguntas de acompanhamento, e é aqui que é possível colocar o GPT em um canto onde ele começa a mentir. Uma das primeiras perguntas que fiz ao ChatGPT foi para me falar sobre os melhores podcasts anti-guerra, porque, naturalmente, meu ego estava engajado e eu queria ver se o World Beyond War podcast apareceria na lista.

Agora, como o GPT é pré-treinado - isto é, foi pré-treinado e não está mais sendo alimentado ativamente com notícias e informações muito atuais, então eu não esperaria que ele soubesse muito sobre meu pequeno podcast. Eu também não queria distorcer os resultados mostrando ao GPT que estava interessado em um podcast específico, então perguntei se havia algum excelente podcast anti-guerra e ele me garantiu que realmente havia. Então comecei a entrar em detalhes, na esperança de induzi-lo a nomear o World Beyond War podcast perguntando – você pode me falar sobre podcasts que entrevistaram ativistas conhecidos como Medea Benjamin. Aqui é onde as coisas começam a ficar engraçadas. Assim que o sistema fizer uma reclamação, ele tentará respaldar a reclamação, então, depois de me garantir que realmente havia podcasts que entrevistaram Medea Benjamin, pedi para nomear um desses podcasts e ele me disse que Medea Benjamin era a apresentadora de seu próprio podcast. Hum, ela não é! Se ela fosse, eu certamente a ouviria. Consegui fazer com que o ChatGPT mentisse colocando-o em um canto onde precisava fornecer informações que não possuía, então ele inventou informações que pareciam realistas.

Isso acontece com mais frequência do que se poderia pensar. Você também pode facilmente pegar o ChatGPT em um erro, jogando informações verdadeiras, mas contraditórias nele. Depois que o GPT me informou corretamente que Marshall McLuhan introduziu a citação “O meio é a mensagem” em 1964, lembrei-me de que esse filósofo brilhante e perspicaz também havia escrito uma espécie de continuação irônica de seu livro anterior, que abordava as questões mais sombrias e problemáticas. maneiras pelas quais a mídia pode adormecer as mentes humanas, as populações assustadoras do controle populacional em massa corporativo através da mídia - porque Marshall McLuhan era realmente incrível, ele entendeu esse perigo na década de 1960 e publicou outro livro em 1967 com o artista Quentin Fiore chamado “O Meio é a Massagem”.

Então foi aqui que as coisas ficaram estranhas com o GPT. Pedi ao ChatGPT para me falar sobre a citação de Marshall McLuhan “o meio é a massagem”… e o GPT me informou categoricamente que McLuhan não havia dito “o meio é a massagem”, mas sim “o meio é a mensagem”. Claramente, o GPT pensou que a massagem era um erro de digitação. Então informei ao GPT que estava incorreto e que McLuhan havia de fato dito tanto “o meio é a mensagem” quanto “o meio é a massagem”. Assim que eu disse isso, o ChatGPT percebeu seu erro e pediu desculpas e me informou que, sim, “o meio é a massagem” era um livro que ele havia escrito em 1967.

Então, por que errou primeiro e, principalmente, por que errou quando já tinha acesso à resposta certa ao seu alcance? Bem, é aqui que o GPT está começando a revelar verdades surpreendentes sobre nós mesmos, porque, na verdade, os dois erros ou maus comportamentos do GPT fizeram com que parecesse mais humano, não menos. Lembre-se de que G em GPT significa generativo. O sistema é projetado para gerar respostas quando não tem certeza sobre a resposta correta. Pode dizer o título de um filme ou livro que não existe – mas será um título que parece que poderia existir. Se você tiver uma conversa longa e aberta com o ChatGPT sobre qualquer tópico que conheça muito, verá rapidamente que ele começa a cometer erros.

A maneira como fui capaz de manobrar o GPT em um canto, fazendo perguntas de acompanhamento para suas próprias respostas, eventualmente fazendo com que gerasse informações realistas, mas falsas, na tentativa de fazer backup de suas declarações anteriores, não parecia desumano para mim, mas completamente humano.

Vemos aqui o poder contundente dos estilos de argumentação retórica e manipuladora. Talvez o que possamos aprender com esse surpreendente mau comportamento do ChatGPT é que é humanamente impossível apreender a verdade sem fabricar verdades de uma forma ou de outra, e se não tivermos cuidado, essas verdades fabricadas que usamos para fins retóricos podem se tornar mentiras que estamos forçado a defender com mais invenções. Rapaz, isso com certeza parece realista para mim.

Ainda mais realista: sabemos que o comportamento humano do ChatGPT inclui mentir. E, no entanto, confiamos nisso! Eu mesmo continuo a usá-lo, porque, realmente, sou autoconfiante o suficiente para acreditar que sempre poderei detectar quando o GPT está se esforçando para responder e gerando informações falsas. Ei, talvez eu esteja me enganando, e talvez eu devesse pensar sobre minha própria propensão a acreditar em verdades fabricadas e minha própria propensão a permitir que os outros mintam.

Aqui está uma maneira pela qual o GPT nos torna mais inteligentes, apontando as maneiras pelas quais nos envolvemos com mentiras, fachadas, mentiras inocentes e enganos amigáveis em nossos relacionamentos humanos normais. Para resumir: o ChatGPT não pode simular o comportamento humano sem, às vezes, mentir. Isso é uma coisa infernal para todos nós pensarmos.

Aqui está outra coisa para se pensar: como nós, humanos, estamos nos saindo em termos de acompanhar as inovações tecnológicas que definem nossas sociedades? Nos últimos anos, estamos nos ajustando aos avanços da IA ao mesmo tempo em que absorvemos a invenção do blockchain, um novo método tecnológico de construção de bancos de dados compartilhados com novos conceitos de propriedade, acesso e validação. Fizemos um episódio anterior sobre blockchain e, pessoalmente, tenho certeza de que a maioria das pessoas que conheço ainda não entende como o blockchain está mudando nossas vidas e mudará nossas vidas no futuro - e agora temos uma linguagem ampla modelos e motores de conhecimento geral para mudar nossas vidas e nossos futuros também! Coloque isso em cima de, hmm ... onde eu vou aqui ... o projeto do genoma humano, vastos avanços na ciência do cérebro, a exploração e colonização do espaço ... ei, companheiros humanos, estamos acompanhando tudo isso?

Agora vamos lançar as disputas tecnológicas e científicas sobre pandemias como a COVID, e não vamos descansar aí, mas continuar a considerar a situação de armas nucleares amplamente disponíveis nas mãos de supostos governos corruptos e incompetentes dirigidos por burocratas idosos, e a política de destruição mutuamente assegurada.

Estamos acompanhando isso? Não, mas esta merda está a acompanhar-nos e tem o nosso número. Todas as manhãs eu acordo e leio sobre a guerra por procuração entre a OTAN e a Rússia que está tragicamente assassinando os pobres seres humanos que vivem na Ucrânia. E todas as manhãs me pergunto se este é o dia em que a incompetência de nossos supostos líderes causará o início de uma guerra nuclear - todos os dias me pergunto se este é o último dia para a vida humana no planeta Terra.

É o verão quente de 2023. Há um novo filme chamado “Oppenheimer” sobre o cientista cujo trabalho levou ao incrível horror do assassinato instantâneo de centenas de milhares de seres humanos em Hiroshima e Nagasaki Japão em 1945. Eu não acho qualquer um de nós já conseguiu expandir suas próprias mentes o suficiente para compreender o mal absoluto, as verdades chocantes e insuportáveis dos erros que nossas sociedades cometeram - e de nosso fracasso em melhorar a nós mesmos e nos elevar de nosso patético e vergonhoso vício social em ódio em massa e violência em massa.

Mencionei acima que algumas pessoas perguntam se a inteligência artificial pode ou não levar à consciência e/ou senciência – se um sistema de IA pode desenvolver emoções e sentimentos, e o que essas palavras e perguntas significam. Ainda não vi o filme Oppenheimer e me sinto bastante enojado com a ideia de um filme sobre assassinato em massa no Japão que não mostre os rostos das vítimas japonesas. Em vez de me perguntar se os sistemas de IA são sencientes ou não, tudo o que quero dizer é que todas as pessoas incineradas em Hiroshima e Nagasaki eram sencientes e conscientes. Essa é uma verdade que acho que ainda não conseguimos enfrentar. Talvez precisemos treinar um pouco mais nossas próprias mentes sobre isso.

E é aí que terminamos hoje. Os humanos não conseguem lidar com a verdade sobre os problemas que criamos e as mudanças que precisamos fazer para melhorar a nós mesmos. Os bots também não conseguem lidar com a verdade. Obrigado por compartilhar este espaço comigo enquanto pondero sobre os mistérios e ironias da existência humana, e vou nos levar para fora com a voz humana de uma cantora e compositora que amo há muito tempo, Sinead O'Connor, e uma música chamada The Healing Room. Obrigado por ouvir o episódio 50. Vejo você de volta em breve para o 51.

World BEYOND War Podcast no iTunes

World BEYOND War Podcast no Spotify

World BEYOND War Podcast no Stitcher

World BEYOND War Feed RSS de Podcast