Marc Eliot Stein, World BEYOND War, 31 lipca 2023

To jest pełny zapis odcinka 50 World BEYOND War: nowy podcast.

Jest lipiec, upalne lato 2023 roku. Wiesz kim jestem, jestem Marc Eliot Stein, dyrektor ds. World Beyond War, wciąż tutaj, na ziemiach Lanape na Brooklynie w Nowym Jorku, nadal postępując właściwie tutaj World Beyond War Podcast, Z wyjątkiem tego, że dzisiejszy dzień jest wyjątkowy, ponieważ jest to odcinek 50, wow, okrągła liczba.

Kiedy zaczynałem ten podcast, chyba nigdy nawet nie myślałem o tym, czy kiedykolwiek dotrę do 50 odcinków. Liczba 50 z pewnością nie wydawałaby się wtedy realistyczna. Myślę, że głównie zastanawiałem się, czy kiedykolwiek ukończę odcinek numer 1, i zanim to zrobiłem, było kilka bliskich rozmów z poddaniem się.

A oto mam 50 lat i jaka to radosna rzecz, uświadomić sobie, że wymyśliliśmy, jak sprawić, by ten antywojenny podcast rzeczywiście działał i znaleźliśmy publiczność, która rośnie z każdym miesiącem. Jestem bardzo dumny z tego podcastu i jestem wdzięczny wszystkim, którzy do tej pory byli jego częścią.

Podcasting to wyjątkowy format kreatywny. To nie jest jak nic innego. Wiem to, ponieważ sam jestem uzależniony od podcastów. Mam co najmniej 20 regularnych programów, na których naprawdę mi zależy – o historii, polityce, technologii, muzyce, literaturze, telewizji, filmach. Kiedy mam ochotę się zrelaksować i jednocześnie poszerzyć swoją wiedzę, naprawdę nie ma innego formatu, który uderza tak, jak podcast. Myślę, że to ważne rozróżnienie: umieść gospodarza i gościa na webinarze lub czacie transmitowanym na żywo, a oni będą mieli jeden rodzaj rozmowy, ale jeśli umieścisz te same osoby w wywiadzie podcastowym, w jakiś sposób oni Będę miał inny rodzaj rozmowy – prawdopodobnie bardziej osobisty, bardziej spontaniczny, bardziej chaotyczny, bardziej w tej chwili, mniej ukierunkowany na dojście do konkluzji.

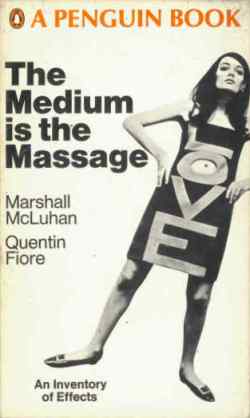

Dlaczego akurat to? Nie wiem, ale nieżyjący już filozof mediów i technologii, Marshall McLuhan, napisał coś w 1964 roku o tym, jak szybko nowa popularność telewizji zmienia współczesne społeczeństwo, i miał rację. Medium, powiedział McLuhan, jest przesłaniem. Forma to treść.

Na przykład możesz napisać te same słowa na Facebooku, Twitterze i LinkedIn, a słowa te będą miały w każdym przypadku inne znaczenie. Ponieważ podcasty celebrują spontaniczny i niewyćwiczony ludzki głos, podcasty stały się forum, na którym można łatwo powitać i zrozumieć ludzką ambiwalencję, a nawet kłopotliwą sprzeczność i ironię. Myślę, że to dobre forum do rozmowy o trendzie, który jest bardzo popularny w wiadomościach i którym mam wiele własnych, ambiwalentnych i kłopotliwych przemyśleń, którymi chcę się z wami dzisiaj podzielić. Mówię o sztucznej inteligencji.

Kiedy Marshall McLuhan powiedział, że medium jest przekazem w 1964 roku, kiedy niewielu ludzi myślało o subtelnych sposobach, w jakie telewizja i inne intymne domowe media telewizyjne zmieniają strukturę ludzkiego społeczeństwa. Obecnie nowe medium, na które pozwala dzisiejsza najnowocześniejsza technologia, również może mieć ogromny wpływ na społeczeństwo. Mówię o popularnych narzędziach sztucznej inteligencji ogólnego przeznaczenia, takich jak ChatGPT, które są dostępne dla każdego, kto ma połączenie z Internetem – a jeśli nie słyszałeś o ChatGPT, wszędzie przyciąga ono wiele uwagi ze względu na to, jak dobrze naśladuje ludzką rozmowę i jak bez wysiłku może zintegrować i odzyskać całe szerokie spektrum dostępnej wiedzy ogólnej.

Chatboty istnieją już od kilku lat – mogą być tak proste i nieszkodliwe, jak przyjazne, zautomatyzowane chatboty obsługi klienta na stronie BestBuy lub Ticketmaster. Nowe chatboty, takie jak ChatGPT4, nie ograniczają się do produktów elektronicznych czy biletów na koncerty – są to bardzo różne rodzaje silników wiedzy, znanych jako duże modele językowe, wyszkolone w celu uchwycenia całości ludzkiej inteligencji.

Czasami ludzie myślą, że G w ChatGPT jest dla generała i byłoby to przyzwoite przypuszczenie, ponieważ system został zaprojektowany w celu wykazania ogólnej inteligencji i ogólnej wiedzy. G faktycznie oznacza Generative, co oznacza, że ten produkt jest również przeznaczony do tworzenia rzeczy – do generowania oryginalnych obrazów i słów. P oznacza pre-trained, o którym porozmawiamy za kilka minut, a T oznacza Transformer, który nie jest klasycznym albumem Lou Reeda, ale wzorcem projektowym oprogramowania pozwalającym modelowi językowemu reagować na wprowadzane teksty nie przetwarzając jedno słowo na raz, ale biorąc pod uwagę i przeprowadzając transformacje na całym wprowadzonym tekście jako całości.

Te nowe chatboty mogą rozmawiać na każdy temat w przyjaznym, interpersonalnym, pełnym niuansów stylu konwersacyjnym. Chatboty mogą pisać eseje, rozwiązywać problemy, przeprowadzać głębokie przeszukiwanie baz danych, generować kod komputerowy, błyskawicznie odpowiadać na trudne pytania. ChatGPT i inne podobne oferty wykazują poziom językowej i wszechstronnej sprawności, który wydaje się posuwać dziedzinę sztucznej inteligencji do przodu szybciej, niż wielu z nas spodziewało się, że będzie to możliwe. Niedawno pojawiła się wiadomość, że niektórzy pracownicy Google wierzyli, że ich własny system sztucznej inteligencji może przejść test Turinga i stać się nie do odróżnienia od czującej komunikacji międzyludzkiej, przerażając własnych ekspertów Google dowodami świadomości. Nie wiem, czy osobiście wierzę, że jakakolwiek sztuczna inteligencja może przejść test Turinga, ale wiem, że wielu ekspertów uważa, że staje się to możliwe.

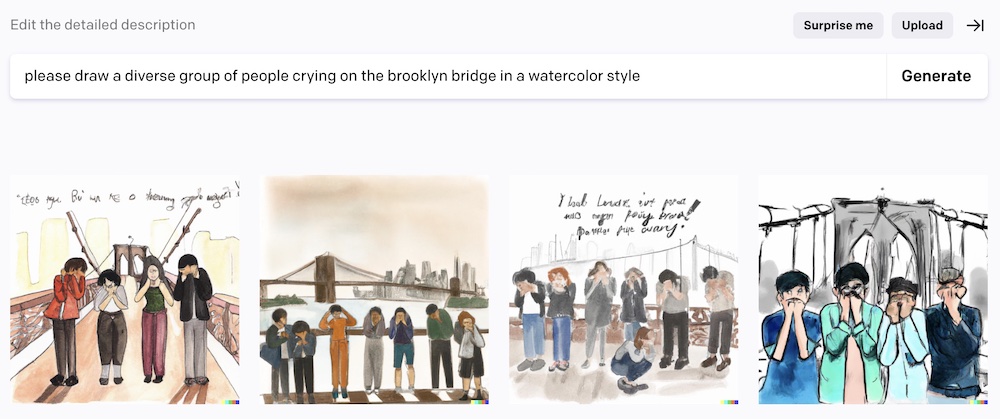

Chatboty wiedzy ogólnej nie są jedynym popularnym przypadkiem użycia sztucznej inteligencji. Generatory obrazów mogą natychmiast tworzyć dzieła sztuki wizualne z monitów tekstowych – czasem zaskakujących, sprytnych obrazów, których stworzenie zajęłoby fizycznym malarzom lub artystom cyfrowym godziny, dni lub tygodnie. Generowanie obrazów z monitów tekstowych jest dziś rzeczywistością dzięki darmowym internetowym generatorom obrazów sztucznej inteligencji, takim jak DALL-E, z OpenAI, tej samej firmy z Doliny Krzemowej, która stworzyła ChatGPT. Możesz wyobrazić sobie pomysł i opisać styl malowania, a ta usługa internetowa magicznie wysyła Ci kilka różnych wariantów prób uchwycenia Twojego pomysłu.

To jest rzeczywistość dzisiaj, i jest to również rzeczywistość dzisiaj, że ChatGPT4 może pisać biegle, przemyślane, obszerne eseje na prawie każdy temat, o który zostanie poproszony – eseje, które mogą być wystarczająco dobre, aby zdobyć wyższe stopnie naukowe.

Być może jest jeszcze za wcześnie na takie prognozy, ale wydaje się, że inteligentne chatboty i generatory obrazów – pismo generowane maszynowo i sztuka generowana maszynowo – stanowią główną innowację technologiczną i główną innowację społeczną, która w pewien sposób wpłynie na nas wszystkich na ziemi lub inny. Kto wie, w jakim kierunku potoczy się obecnie przyszłość, ale wydaje się przynajmniej możliwe, że uruchomienie ChatGPT3 w 2022 roku zostanie kiedyś zapamiętane jako ważny moment w historii kultury, podobny do uruchomienia przeglądarki Mosaic w 1993 roku, która zapoczątkowała całą popularną Internetowy boom, w którym żyjemy do dziś.

Wydaje się również możliwe, co z niepokojem stwierdzam, że ta nowa innowacja spowoduje nowe rodzaje poważnych problemów, z którymi wszyscy będziemy musieli się uporać, nawet jeśli wielu z nas może czuć, że nasze społeczeństwo już tonie w niechcianych następstwach inne innowacje technologiczne, o które nie prosiliśmy w naszym życiu, których nie zaprosiliśmy do naszego życia, a które mimo to są w naszym życiu.

Chcę spędzić ten odcinek, rozmawiając o tym, jak sztuczna inteligencja wpływa na nas jako działaczy antywojennych. Pozwólcie, że powiem to z góry: sztuczna inteligencja to gorący temat, bardzo kontrowersyjny i tak powinno być. Powinniśmy się tym martwić i powinniśmy o tym rozmawiać, a moim zdaniem powinniśmy też otworzyć umysły na dobro, jakie ta technologia może zdziałać.

Jest kontrowersyjny wśród postępowców i aktywistów i jest kontrowersyjny dla wszystkich. To powinno być kontrowersyjne, a nie robię tego odcinka, ponieważ mam proste odpowiedzi na pytanie, jak te ostatnie innowacje mogą wpłynąć na naszą planetę. Wiem, że wpłyną na nasz świat i wiem, że działacze antywojenni muszą o tym mówić. Robię więc ten odcinek, aby rozpocząć rozmowę, aby przedstawić różne kwestie, z którymi, jak sądzę, zmaga się wielu działaczy antywojennych, kiedy rozmawiają na ten temat, i być może, aby wyrazić zrozumienie dla wszystkich stron tego kłopotliwego kwestie. Właśnie to postaram się tutaj zrobić – a kiedy skończysz słuchać tego odcinka, podziel się swoją opinią na naszym world beyond war stronę internetową tego odcinka lub kontaktując się bezpośrednio ze mną – łatwo mnie znaleźć.

Jeśli chodzi o wpływ na codzienne życie, wielu zastanawia się, czy niesamowite możliwości sztucznej inteligencji pozbawią pracy wielu ludzi. Jest to często pierwsza obawa, która pojawia się u ludzi, gdy widzą moc sztucznej inteligencji. Czy te zaawansowane możliwości spowodują, że różne sektory zdrowego zatrudnienia i dążenia ludzi staną się nagle niechciane? Nasze społeczeństwo jest już mocno wytrącone z równowagi, jeśli chodzi o to, kto pracuje, kto zarabia, a kto wydaje. Jeśli ekosystemy klasy średniej pracującej zarobkowo zostaną jeszcze bardziej zakłócone, ponieważ sztuczna inteligencja może wykonywać wiele takich samych zadań lepiej i za darmo, możemy być pewni, że zakłócenie zwiększy przepaść między bogatymi a resztą z nas, że 1 % będzie mógł skorzystać na zmianie, podczas gdy reszta z nas będzie musiała stawić czoła konsekwencjom, a ten 1% sprawi również, że narzędzia AI, które pomogą 1%, będą niedostępne dla osób, które mogłyby skorzystać z ich pomocy, lub będą zbyt drogie dla im dostęp.

Spójrzmy prawdzie w oczy, w drapieżnych gospodarkach kapitalistycznych, w których wielu z nas utknęło, bezrobocie oznacza popadanie w długi i utratę wolności wyboru, i to jest dokładnie to, do czego te socjopatyczne gospodarki-twierdze mają służyć zwykłym ludziom – odbierać nam władzę z wyboru i zmuszają nas do płacenia im i pracy dla nich. Oto wizja przyszłości dzisiejszego kapitalizmu-twierdzy: będziemy mieć nowe, inteligentne i potężne komputery, ponieważ sami jesteśmy zubożeni.

Faktem jest również, że policja i wojsko już zaczynają używać narzędzi sztucznej inteligencji, a także nowych, potężnych i brutalnych robotów. Myślę, że może to być najpoważniejsze i najbardziej bezpośrednie zagrożenie, jakie obecnie stwarza sztuczna inteligencja, i myślę, że ruchy protestacyjne oblegane przez policję, takie jak, powiedzmy, ważny ruch Stop Cop City w Atlancie w stanie Georgia, już radzą sobie z tą zmienioną rzeczywistością. Systemy sztucznej inteligencji niosą uprzedzenia i zakodowane wartości ich ludzkich twórców, więc wyszkolona przez sztuczną inteligencję policja lub wojsko grozi, że stanie się dosłownymi maszynami do polowania i zabijania wrażliwych populacji, wybierając swoje cele na podstawie wyglądu lub rasy. W świecie, który już wymyka się spod kontroli wojną od Ukrainy po Jemen, pomysł wzmocnienia pozycji jednej lub drugiej strony – i nieuchronnie obu stron – za pomocą nowych rodzajów maszyn do morderstwa i reżimów tłumienia zaszyfrowanych za pomocą okrutnego profilowania rasowego jest równie przerażający, jak to brzmi.

Najgorsze scenariusze masowego bezrobocia lub rasowo zakodowanej sztucznej inteligencji wykorzystywanej przez policję i siły zbrojne są przerażające i nie możemy z tym spać, ponieważ skutki są już w naszym świecie. To już się dzieje. Zacznijmy więc tę rozmowę od przyznania, że dwa odrębne horrory, które wydaje się przedstawiać zaawansowana sztuczna inteligencja – masowe bezrobocie i nadużycia ze strony policji i sił zbrojnych – to dwa różne sposoby, w jakie potężne siły ugruntowanego bogactwa i przywilejów kradną ludziom prawa i wolności .

Mówiąc o zakorzenionym bogactwie i przywilejach – porozmawiajmy o OpenAI, firmie w Północnej Kalifornii, którą można znaleźć online pod adresem OpenAI.com. Ta firma była mało znana, dopóki nie uruchomiła generatora obrazów DALL-E w 2021 r., a następnie w listopadzie 2022 r., zaledwie dziewięć miesięcy temu, wypuściła swojego pierwszego publicznego chatbota, ChatGPT3, a wkrótce potem pojawiły się potężniejsze i bardziej wydajne ChatGPT3.5 i ChatGPT4 , dostępne obecnie wersje.

Byłem całkiem znokautowany, kiedy po raz pierwszy zobaczyłem obrazy, które DALL-E może stworzyć, i byłem jeszcze bardziej znokautowany, gdy po raz pierwszy spróbowałem ChatGPT. Wyzwanie, któremu próbowały sprostać te narzędzia, było mi dobrze znane, ponieważ sam intensywnie studiowałem sztuczną inteligencję, podobnie jak wielu programistów. Moje pierwsze spotkanie ze sztuczną inteligencją było niezależnym projektem badawczym, który zrobiłem na studiach, kilka dekad temu.

To były lata 1980. i być może niektórzy bardzo młodzi ludzie będą zaskoczeni, słysząc, że ludzie tacy jak ja zajmowali się sztuczną inteligencją w latach 1980., ale termin sztuczna inteligencja jest prawie tak stary, jak sama rewolucja komputerowa. Mimo że osiągnięcia sztucznej inteligencji od lat 1950. do 1990. XX wieku były infantylne w porównaniu z postępem, jaki widzieliśmy od tamtego czasu.

Dziedzina była tak otwarta w latach 80., że mogłem zdobyć kilka punktów podczas mojego ostatniego roku jako połączony kierunek filozofii i informatyki, przygotowując oryginalny niezależny projekt badawczy dla programu, który analizowałby zdania w języku angielskim i odpowiadać w sposób demonstrujący lub symulujący podstawowe zrozumienie. Kodowałem w LISP-ie na przezabawnie masywnym, świecącym na zielono terminalu Unimatic, podłączonym do ogromnego komputera typu mainframe Univac, który był wielkości dużego budynku i prawdopodobnie miał mniej mocy niż MacBook, na którym teraz nagrywam ten podcast, ponieważ tak się potoczyliśmy jeszcze w latach 80.

Ekscytującym wyzwaniem mojego niezależnego projektu badawczego AI było analizowanie i odpowiadanie na zdania, które zawierały proste czasowniki i rzeczowniki. Na przykład wpisywałbym zdania takie jak „Mam kota o imieniu Happy”, „mój kot jest pomarańczowy” i „wszystkie koty miauczą” w moim programie LISP-a, co wykazałoby pewne zrozumienie, odpowiadając na pytania typu „czy Happy jest pomarańczowy?” lub „czy kot Marca miauczy?”. Co zabawne, próbowałem stworzyć chatbota AI na moim komputerze głównym Univac.

Założę się, że wielu innych studentów college'u próbowało zrobić to samo w tamtym czasie, ale żadnemu z nas nie udało się zajść daleko, ponieważ były to lata 1980. strukturę zaprojektowaną do przeprowadzania masowo równoległych prostych operacji, podobnych do neuronów w ludzkim mózgu. Podczas gdy mój program LISP zapewniał obliczenia jednowątkowe, a programy Fortran, COBOL i Pascal stosowały ten sam ograniczony paradygmat jednowątkowy, sieci neuronowe zapewniały równoległe wątki elementarne, które równolegle wykonywały proste obliczenia. Mózg ludzki wykonuje wiele operacji przetwarzania równoległego – operacje kaskadowe nakładają się kaskadowo, tworząc iluzję osobliwości – a struktura oprogramowania znana jako sieć neuronowa pozwoliłaby programistom wykorzystać moc tego przetwarzania równoległego – po ukończeniu studiów.

Wraz z koncepcją sieci neuronowej w końcu pojawiła się koncepcja uczenia sieci neuronowej z powtarzalnymi czynnościami – kolejna koncepcja, która nie dotarła do nas jeszcze w latach 80-tych. Karmiłem mój program LISP niewielką liczbą pełnych zdań i nie dawałem mu żadnych informacji zwrotnych, dzięki którym mógłby poprawić i ulepszyć jego działanie. To, co powinienem był robić, zamiast wpisywać zdania na moim terminalu komputerowym, to karmić go całymi książkami, gazetami i encyklopediami i stale wchodzić z nim w interakcje, aby dostarczać informacji zwrotnych na temat jego zachowania, podczas gdy mój program wielokrotnie próbował symulować najbardziej podstawowe, prymitywne czynności zrozumienia. Dając mu dużo materiałów do czytania, aby zbudować bogatą i złożoną bazę wiedzy oraz powtarzając i gruntownie go szkoląc, mogłem sprawić, że mój program komputerowy powie coś zaskakującego o tym, czy mam kota, który jest pomarańczowy, czy nie. Okazuje się, że sieci neuronowe i powtarzalne szkolenia pomogły utorować drogę do udanych symulacji ludzkiej inteligencji, które obserwujemy dzisiaj za pomocą chatbotów.

Zauważysz, że mówię o symulowaniu ludzkiej inteligencji. Wskazuje to na kolejną kontrowersję. Niektórzy uważają termin „sztuczna inteligencja” za śmieszny. Co gorsza, niektórzy uważają ten pomysł za etycznie niepokojący, ponieważ jeśli inteligencja daje początek świadomości, sztuczna inteligencja może przekształcić się w sztuczną świadomość – sztuczne czucie, sztuczną samowolę, sztuczne prawo do istnienia. To z pewnością przywołuje wiele egzystencjalnych pytań. Wszystkie te pytania są aktualne i ważne. Niektórzy zastanawiają się, czy silniki wiedzy AI i modele językowe mogą już rozwijać świadomość. Osobiście uważam, że całkiem łatwo jest zadeklarować, że nie, nie musimy się martwić, że chatboty rozwiną rzeczywiste uczucia. Istnieje wiele różnych aspektów sztucznej inteligencji, o które należy się martwić, a ja osobiście nie martwię się o ten. Ale to nie znaczy, że mogę udowodnić, że mam rację i że nikt nie powinien się tym przejmować. Może po prostu jestem tak przytłoczona różnymi rzeczami, którymi powinnam się martwić, że nie mam czasu na martwienie się tą. Nie mam definitywnej odpowiedzi na wszystkie pytania, które mogą się pojawić w związku z kwestiami wrażliwości maszyn, i nie zamierzam udawać, że mam. Ale wiem, z jakimi pytaniami musimy się zastanowić, jak sobie z nimi poradzić.

Jedna z opinii, które czasami słyszę w społecznościach aktywistów, mówi, że sztuczna inteligencja to kupa szumu – iluzja, którą wspierają doskonałe umiejętności konwersacyjne dużego modelu językowego. Jasne, GPT może przeanalizować pytanie i odpowiedzieć w eleganckiej frazeologii, ale dlaczego ta szczęśliwość z językiem miałaby sprawiać, że wyobrażamy sobie, że dokonano jakiegoś znaczącego postępu? Google i Wikipedia już udostępniły całą ludzką wiedzę za darmo w Internecie, ku konsternacji Encyklopedii Britannica. Słyszymy cały ten szum wokół ChatGPT po prostu dlatego, że przedstawia językową fasadę ludzkiej świadomości, iluzję, w którą wszyscy tak chętnie się zakochujemy. Myślę, że jest tu pewna słuszność. Może gdyby Google lub Wikipedia wystartowały w sposób nagły i w pełni uformowany, jak zrobił to ChatGPT, może mówilibyśmy o uruchomieniu Google lub Wikipedii jako ogromnego postępu w zbiorowej ludzkiej inteligencji, ponieważ oba z nich już wpłynęły na nasz świat.

Mimo to, jak wspomniałem powyżej, kiedy mówiłem o sieciach neuronowych i szkoleniu, opisywanie dużych modeli językowych jako fasad jest niedocenianiem warstw struktury oprogramowania, które muszą istnieć, aby ta językowa pomyślność była możliwa.

Oto moim zdaniem poważniejsze pytanie: przyjrzyjmy się etyce OpenAI i jej zleceniodawców, założycieli, inwestorów i partnerów. Tu jest cała masa problemów.

OpenAI.com to finansowane ze środków prywatnych laboratorium badawcze wywodzące się z tego samego niezwykle bogatego i rozwijającego się ekosystemu inkubatorów technologicznych Doliny Krzemowej, który dał nam Facebook, Google, Microsoft, Amazon i Oracle. Wśród jej założycieli jest Elon Musk, celebryta-miliarder, którego socjopatyczne publiczne uwagi naprawdę przyprawiają mnie o mdłości tak samo, jak wielu innych ludzi. Elon Musk nigdy nie był bezpośrednio zaangażowany w OpenAI i przeszedł do innych rzeczy, takich jak pokazywanie swojej ofensywnej osobowości w mediach społecznościowych, więc to wszystko, co chcę dziś powiedzieć o Elonie Musku.

Moim zdaniem jeszcze bardziej potępiające jest to, że OpenAI jest ściśle powiązane z Microsoftem, głównym spekulantem wojennym i głównym spekulantem w dziedzinie sztucznej inteligencji na potrzeby wojny. Mam nadzieję, że ludzie będą się martwić tym niepokojącym skojarzeniem, nawet bardziej niż połączeniem Elona Muska. Powinniśmy być bardzo zaniepokojeni faktem, że przyjazne oblicze DALL-E i OpenAI jest użyteczną fasadą dla co najmniej jednego masowo wpływowego i spekulanta wojennego, Microsoftu, który już opracowuje rodzaje wojskowych i policyjnych aplikacji sztucznej inteligencji, o których mówiliśmy o powyżej. To już dzieje się za kulisami Microsoftu i innych amerykańskich gigantów technologicznych, którzy są głęboko powiązani z amerykańską machiną wojenną. I to jest chyba najgorsza wiadomość, jaka przychodzi mi do głowy.

My w ruchu antywojennym nie możemy odwrócić się od sztucznej inteligencji z powodu jej złego potencjału. Nie mam oczywiście na myśli tego, że każdy w ruchu antywojennym musi pozwalać na technologiczne ingerencje we własne życie. Cieszę się, że wielu postępowców i aktywistów dokonuje rozsądnego wyboru, aby uniknąć modnych innowacji technologicznych w swoim życiu. Potrafię odnosić się do tej postawy i ją szanować, mimo że sam jestem daleki od stylu życia wolnego od technologii. Technologia to moja dziedzina, moja kariera, a jako technolog jestem zafascynowany geniuszem, kreatywnością i innowacjami stojącymi za przedsięwzięciami takimi jak sztuczna inteligencja.

Ponadto, po prostu jako ciekawska osoba, jestem absolutnie zainteresowany uzyskaniem wglądu w ludzką inteligencję poprzez uczenie się, w jaki sposób komputery zostały stworzone do jej symulacji. Wpuszczam również ChatGPT do mojego życia, ponieważ odkryłem, jak bardzo jest to przydatne. Wchodzę na OpenAI.com i ciągle zadaję mu pytania. Używam ChatGPT do pisania kodu, w tym Javascript dla nowej wersji naszej interaktywnej mapy amerykańskich zagranicznych baz wojskowych, nad którą pracuję tego lata wraz z innymi ludźmi w World Beyond War.

Powiedzmy, że chcę wyczyścić parametr ciągu zapytania, usuwając znaki specjalne za pomocą wyrażenia regularnego, o co poprosiłbym Stack Overflow, i złożyłbym mój działający kod z zalecanych fragmentów opublikowanych w wątku konwersacji . Zamiast tego mówię teraz ChatGPT, czego chcę, a ChatGPT po prostu wypluwa doskonale sformatowany JavaScript, wykonywalny i wolny od błędów. Większość moich znajomych programistów używa teraz ChatGPT do pisania kodu – wiem, że to robimy, ponieważ lubimy o tym rozmawiać. Myślę, że żaden z nas, programistów, nie martwi się jeszcze, że ChatGPT nas zastąpi, ponieważ to my musimy złożyć fragmenty kodu, aby stworzyć działające systemy, a GPT po prostu produkuje fragmenty kodu. Zastanawiam się jednak, jak zmieni to sposób pracy programistów. To zdecydowanie już zmienia grę.

Używam również ChatGPT do wyszukiwania rzeczy online w sposób, w jaki korzystałbym z Google, i używam go do podpowiedzi i perspektyw oraz podstawowych informacji na temat rzeczy, o których piszę lub o których myślę. Nie żartuję, kiedy mówię, że używam go do wszystkiego – na przykład, kiedy wspomniałem powyżej o filozofie technologii z lat 1960. opublikował książkę, która mówi, że „medium jest przesłaniem”.

Fakt, że tak wielu z nas przeszło już z Google na GPT w celu wykonywania podstawowych wyszukiwań w Internecie, wiele mówi. Bardzo łatwo jest zacząć pozwalać, aby te nowe rodzaje narzędzi powoli i niepostrzeżenie wkroczyły w nasze życie, nawet jeśli martwimy się implikacjami i motywacjami, które za nimi stoją.

Podobnie jak leżąca u podstaw technologia oprogramowania samego Internetu, która została stworzona z wątpliwych powodów przez armię amerykańską, ale spowodowała zmiany społeczne i znalazła nowe zastosowania, które były całkowicie poza zakresem jej pierwotnego celu, ta nowa technologia będzie znaleźć własną drogę do wpływania na nasze życie. Ta nowa technologia jest prawdziwa, działa zbyt dobrze, aby ją zignorować, i już tu zostanie. Ponownie, dlatego spędzam odcinek rozmawiając o tym z działaczami antywojennymi – ponieważ jest to już częścią naszej rzeczywistości i możemy potrzebować niektórych mocy, jeśli oferty, aby wykonać naszą własną pracę tutaj na ziemi.

Poświęćmy chwilę na zastanowienie się nad wieloma aspektami życia na tej planecie, które nie mają strasznych problemów, o których my, działacze antywojenni, tak dobrze wiemy. Sztuka, muzyka, literatura, biologia, chemia, fizyka, geologia, astronomia, medycyna, zdrowie, produkcja, rolnictwo, odżywianie. We wszystkich tych światach, wszystkie te przedsięwzięcia… publiczne uruchomienie wysoce wydajnego chatbota wiedzy ogólnej ma ogromny wpływ. Nie ma pola, którego nie dotyka.

Na płaszczyźnie pokojowego współistnienia ludzi – płaszczyźnie, w której chciałbym spędzać więcej czasu nad samym sobą – sztuczna inteligencja to cudowne rozwinięcie ludzkich możliwości, które obiecuje ogromne korzyści. Gdybyśmy tylko żyli w spokojnym, bezpiecznym i sprawiedliwym świecie, moglibyśmy lepiej wspólnie cieszyć się cudami, które może stworzyć sztuczna inteligencja.

Widzimy niektóre z tych cudów, kiedy pracujemy z generatorem obrazów i tworzymy zdumiewająco sprytne lub kreatywne obrazy w oparciu o nasze własne podpowiedzi, których inaczej nie bylibyśmy w stanie wyprodukować. Czujemy również paradoks dotyczący tego, czy narzędzia sztucznej inteligencji mogą być wykorzystywane w dobrym celu. Jako technik uważam, że to nie innowacje technologiczne są problemem planety Ziemi w XXI wieku. Zawsze z zadowoleniem przyjmuję innowacje technologiczne i myślę, że niebezpieczeństwa stwarzane przez sztuczną inteligencję wynikają z okopanego kapitalizmu i wojny – z faktu, że jest to planeta w stanie wojny z samą sobą, planeta zdominowana przez bogaty 21%, który nie może się oprzeć pokusie samobójcza ścieżka budowania zmilitaryzowanych społeczeństw fortec, które tłumią innych ludzi, aby zachować przywileje. To, co musimy zrobić, to uzdrowić nasze społeczeństwo – nie musimy uciekać od postępu technologicznego, ponieważ źle rozumiemy przyczyny naszej agonii i naszej samobójczej trajektorii.

Tak myślę. Oczywiście nie tak myśli każdy działacz antywojenny i to jest w porządku. Mieliśmy kilka ciekawych reakcji na World Beyond War e-mailowa lista dyskusyjna – które jest żywym i inteligentnym forum, do którego polecam każdemu dołączyć, wystarczy kliknąć link na naszej stronie internetowej lub wyszukać world beyond war lista dyskusyjna – po tym, jak ktoś podzielił się naprawdę pomysłowymi obrazami antywojennymi, które zostały wygenerowane za pomocą DALL-E, a ktoś inny podzielił się zaskakująco przydatnymi słowami o tym, jak nasza chora planeta może znaleźć ścieżki do pokoju na świecie.

Uważam, że aktywiści powinni opanować wszystkie dostępne technologie – że aktywizm nie powinien stawiać się w sytuacji, w której jest mniej zdolny do korzystania z zaawansowanych innowacyjnych technologii niż skorumpowane rządy i chciwe korporacje, które mają w zwyczaju nas uciskać.

Wierzę również, że dzięki studiowaniu algorytmów i wzorców projektowych używanych do jej modelowania i symulowania, możemy również zebrać zaskakujące prawdy filozoficzne na temat ludzkiej świadomości i ludzkiej egzystencji. Wystarczy poświęcić kilka minut na wygłupianie się z ChatGPT na stronie OpenAI, aby odkryć kilka dzikich prawd o ludzkiej naturze.

Oto jedna szalona rzecz, którą wciąż owijam w głowie. ChatGPT czasami kłamie. Tworzy rzeczy. Zwykle nie zobaczysz tego, gdy zaczniesz kwestionować GPT, ponieważ zazwyczaj uzyskasz potężną odpowiedź na pierwsze pytanie w wątku konwersacyjnym. Następnie GPT nadąża za tobą, gdy zadajesz dodatkowe pytania, i tutaj można cofnąć GPT w róg, w którym zaczyna prosto leżeć. Jednym z pierwszych pytań, jakie kiedykolwiek zadałem ChatGPT, było powiedzenie mi o najlepszych antywojennych podcastach, ponieważ naturalnie moje ego było zaangażowane i chciałem zobaczyć, czy World Beyond War podcast pojawi się na liście.

Teraz, ponieważ GPT jest wstępnie wytrenowany – to znaczy został wstępnie wytrenowany i nie jest już aktywnie zasilany na bieżąco bardzo aktualnymi wiadomościami i informacjami, więc nie spodziewałbym się, że będzie wiedział dużo o moim małym podcast. Nie chciałem też wypaczać wyników, pokazując GPT, że jestem zainteresowany jednym konkretnym podcastem, więc zapytałem go, czy są jakieś doskonałe antywojenne podcasty i zapewnił mnie, że rzeczywiście tak jest. Następnie zacząłem wchodzić w szczegóły, mając nadzieję, że skłonię go do nazwania World Beyond War podcast przez zapytanie – czy możesz mi powiedzieć o podcastach, w których przeprowadzono wywiady ze znanymi aktywistami, takimi jak Medea Benjamin. Tutaj zaczyna się robić zabawnie. Gdy system zgłosi roszczenie, spróbuje je poprzeć, więc po zapewnieniu mnie, że rzeczywiście istnieją podcasty, w których przeprowadzono wywiad z Medeą Benjamin, poprosiłem go o nazwanie jednego z tych podcastów, a następnie powiedział mi, że Medea Benjamin był prowadząca własnego podcastu. Ona nie jest! Gdyby była, na pewno bym jej posłuchała. Udało mi się zmusić ChatGPT do kłamstwa, cofając go w róg, w którym musiał podać informacje, których nie miał, więc wymyślił informacje, które brzmiały realistycznie.

To zdarza się częściej niż mogłoby się wydawać. Możesz również łatwo złapać ChatGPT na pomyłce, podrzucając mu prawdziwe, ale sprzeczne informacje. Po tym, jak GPT prawidłowo poinformowało mnie, że Marshall McLuhan wprowadził cytat „Medium jest przesłaniem” w 1964 roku, przypomniałem sobie, że ten błyskotliwy i bystry filozof napisał również coś w rodzaju ironicznej kontynuacji swojej wcześniejszej książki, która odnosiła się do mroczniejszych i bardziej niepokojących sposoby, w jakie media mogą uśpić ludzkie umysły, przerażające populacje korporacyjnej masowej kontroli populacji za pośrednictwem mediów – ponieważ Marshall McLuhan był naprawdę niesamowity, zrozumiał to niebezpieczeństwo już w latach 1960. XX wieku i opublikował kolejną książkę w 1967 r. z artystą Quentinem Fiore o nazwie „Środkiem jest masaż”.

Oto, gdzie sprawy potoczyły się dziwnie z GPT. Poprosiłem ChatGPT, aby opowiedział mi o cytacie Marshalla McLuhana „medium to masaż”… i GPT stanowczo poinformował mnie, że McLuhan nie powiedział „medium to masaż”, ale raczej „medium to przekaz”. Najwyraźniej GPT uważał, że masaż był literówką. Następnie poinformowałem GPT, że to nieprawda i że McLuhan rzeczywiście powiedział zarówno „medium jest przesłaniem”, jak i „medium to masaż”. Gdy tylko to powiedziałem, ChatGPT zrozumiał swój błąd, przeprosił i poinformował mnie, że tak, „medium to masaż” to książka, którą napisał w 1967 roku.

Dlaczego więc popełnił błąd pierwszy, a zwłaszcza dlaczego się pomylił, skoro miał już dostęp do właściwej odpowiedzi w swoim zasięgu? Cóż, tutaj GPT zaczyna ujawniać zaskakujące prawdy o nas samych, ponieważ w rzeczywistości dwa błędy lub niewłaściwe zachowania GPT sprawiły, że wydaje się bardziej ludzki, a nie mniej. Pamiętaj, że G w GPT oznacza generatywny. System ma za zadanie generować odpowiedzi, gdy nie ma pewności co do prawidłowej odpowiedzi. Może powiedzieć ci tytuł filmu lub książki, która nie istnieje – ale będzie to tytuł, który wydaje się, że może istnieć. Jeśli prowadzisz otwartą, długą rozmowę z ChatGPT na dowolny temat, o którym dużo wiesz, szybko zauważysz, że zaczyna popełniać błędy.

Sposób, w jaki udało mi się wmanewrować GPT w kozi róg, zadając mu pytania uzupełniające do jego własnych odpowiedzi, ostatecznie powodując, że generuje realistyczne pozornie, ale fałszywe informacje, próbując wykonać kopię zapasową swoich poprzednich stwierdzeń, nie wydawał mi się nieludzki, ale całkowicie człowiek.

Widzimy tu tępą siłę retorycznych i manipulacyjnych stylów argumentacji. Być może tym, czego możemy się nauczyć z tego zaskakującego niewłaściwego zachowania ChatGPT, jest to, że po ludzku niemożliwe jest zrozumienie prawdy bez fabrykowania prawd w taki czy inny sposób, a jeśli nie będziemy ostrożni, te sfabrykowane prawdy, których używamy do celów retorycznych, mogą stać się kłamstwami, którymi jesteśmy zmuszony do obrony za pomocą kolejnych fabrykacji. Chłopcze, to z pewnością wydaje mi się realistyczne.

Jeszcze bardziej realistyczne: wiemy, że ludzkie zachowanie ChatGPT obejmuje kłamstwo. A mimo to ufamy! Nawet sam go nadal używam, bo tak naprawdę jestem na tyle pewny siebie, by wierzyć, że zawsze będę w stanie wykryć, kiedy GPT stara się o odpowiedź i generuje fałszywe informacje. Hej, może się oszukuję i może powinienem pomyśleć o własnej skłonności do wiary w sfabrykowane prawdy i własnej skłonności do umożliwiania kłamstwa innym.

Oto sposób, w jaki GPT czyni nas mądrzejszymi, wskazując sposoby, w jakie angażujemy się w nieprawdę, fasady, białe kłamstwa i przyjazne oszustwa w naszych normalnych relacjach międzyludzkich. Mówiąc w skrócie: ChatGPT nie może symulować ludzkiego zachowania bez czasami kłamania. To jest cholerna rzecz do przemyślenia dla nas wszystkich.

Oto coś innego do przemyślenia: jak my, ludzie, radzimy sobie, jeśli chodzi o nadążanie za innowacjami technologicznymi, które definiują nasze społeczeństwa? W ciągu ostatnich kilku lat dostosowujemy się do postępów w sztucznej inteligencji, jednocześnie wchłaniając wynalazek blockchain, nowej technologicznej metody budowania współdzielonych baz danych z nowymi koncepcjami własności, dostępu i walidacji. Zrobiliśmy poprzedni odcinek o blockchain i osobiście jestem prawie pewien, że większość ludzi, których znam, nadal nie rozumie, w jaki sposób blockchain zmienia nasze życie i będzie zmieniać nasze życie w przyszłości – a teraz mamy duży język modele i silniki wiedzy ogólnej, które zmienią nasze życie i naszą przyszłość! Dodajmy to do tego, hmm… gdzie ja tu w ogóle jestem… projekt ludzkiego genomu, ogromne postępy w nauce o mózgu, eksploracja i kolonizacja kosmosu… hej, ludzie, czy nadążamy za tym wszystkim?

Dorzućmy teraz technologiczne i naukowe spory dotyczące pandemii, takich jak COVID, i nie poprzestawajmy na tym, ale rozważmy sytuację szeroko dostępnej broni jądrowej w rękach skorumpowanych i niekompetentnych tak zwanych rządów kierowanych przez starzejących się biurokratów, a polityka wzajemnie gwarantowanego zniszczenia.

Czy nadążamy za tym? Nie, ale to gówno nadąża za nami i ma nasz numer. Każdego ranka budzę się i czytam o wojnie zastępczej między NATO a Rosją, która tragicznie morduje biednych ludzi żyjących na Ukrainie. I każdego ranka zastanawiam się, czy to jest dzień, w którym niekompetencja naszych tak zwanych przywódców doprowadzi do wybuchu wojny nuklearnej – każdego dnia zastanawiam się, czy to jest ostatni dzień ludzkiego życia na planecie Ziemia.

Jest gorące lato 2023 roku. Jest nowy film zatytułowany „Oppenheimer” o naukowcu, którego praca doprowadziła do niewiarygodnego horroru natychmiastowego mordu setek tysięcy ludzi w Hiroszimie i Nagasaki w Japonii w 1945 roku. nikomu z nas nie udało się jeszcze rozwinąć własnego umysłu na tyle, by pojąć absolutne zło, szokujące, nieznośne prawdy o błędach popełnionych przez nasze społeczeństwa – oraz o naszej porażce w poprawie siebie i podniesieniu się z naszego żałosnego, haniebnego społecznego uzależnienia od masowa nienawiść i masowa przemoc.

Wspomniałem powyżej, że niektórzy ludzie pytają, czy sztuczna inteligencja może prowadzić do świadomości i/lub odczuwania – czy system AI może kiedykolwiek rozwinąć emocje i uczucia oraz co w ogóle oznaczają te słowa i te pytania. Nie widziałem jeszcze filmu Oppenheimer i czuję się dość zniesmaczony pomysłem filmu o masowych mordach w Japonii, który nie pokazuje twarzy japońskich ofiar. Zamiast zastanawiać się, czy systemy sztucznej inteligencji są świadome, chcę tylko powiedzieć, że każda osoba spalona w Hiroszimie i Nagasaki była świadoma i świadoma. To prawda, której chyba nie udało nam się jeszcze stawić czoła. Może musimy trochę bardziej wytrenować nasze umysły w tej kwestii.

I na tym dzisiaj kończymy. Ludzie nie mogą znieść prawdy o problemach, które stworzyliśmy i zmianach, które musimy wprowadzić, aby się poprawić. Boty też nie radzą sobie z prawdą. Dzięki, że podzieliłeś się ze mną tą przestrzenią, gdy zastanawiam się nad tajemnicami i ironią ludzkiej egzystencji, i zabieram nas ludzkim głosem piosenkarki i autorki tekstów, którą kocham od dawna, Sinead O'Connor, i piosenka zatytułowana The Healing Room. Dziękuję za wysłuchanie odcinka 50. Do zobaczenia wkrótce na odcinku 51.

World BEYOND War Podcast na iTunes

World BEYOND War Podcast na Spotify

World BEYOND War Podcast na Stitcher

World BEYOND War Kanał RSS podcastu