Avtor: Marc Eliot Stein, World BEYOND War, 31. julija 2023

To je celoten prepis 50. epizode World BEYOND War: nov podcast.

Julij je, vroče poletje 2023. Veste, kdo sem, sem Marc Eliot Stein, tehnološki direktor podjetja World Beyond War, še vedno tukaj v deželah Lanape v Brooklynu New York, še vedno dela prave stvari tukaj na World Beyond War Podcast, Le da je danes nekaj posebnega, ker je to epizoda 50, vau okrogla številka.

Ko sem začel s tem podcastom, mislim, da nikoli nisem niti pomislil, ali bom kdaj prišel do 50 epizod ali ne. Številka 50 se takrat zagotovo ne bi zdela realna. Predvidevam, da sem se predvsem spraševal, ali bom kdaj dokončal epizodo številka 1, in bilo je nekaj tesnih klicev z odpovedjo, preden sem to storil.

In tukaj sem pri 50 letih in kako veselo je spoznati, da smo ugotovili, kako narediti ta protivojni podcast zares učinkovit, in našli občinstvo, ki raste vsak mesec. Zelo sem ponosen na ta podcast in hvaležen sem vsem, ki so bili do zdaj del njega.

Podcasting je edinstven ustvarjalni format. Ni kot nič drugega. To vem, ker sem tudi sam odvisnik od podcastov. Imam vsaj 20 rednih oddaj, ki me resnično zanimajo – o zgodovini, politiki, tehnologiji, glasbi, literaturi, televiziji, filmih. Ko sem razpoložen, da se sprostim in hkrati razširim svoje znanje, resnično ni nobene druge oblike, ki bi bila tako uspešna kot podcast. Mislim, da je to pomembna razlika: dajte gostitelja in gosta na spletni seminar, recimo, ali v klepet, ki se predvaja v živo, in imela bosta eno vrsto pogovora, toda če isti dve osebi postavite v podcast intervju, nekako Imel bom drugačno vrsto pogovora – verjetno bolj osebnega, bolj spontanega, bolj razgibanega, bolj v trenutku, manj namenjenega temu, da bi se približal zaključku.

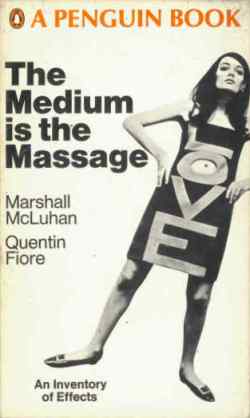

Zakaj točno to? Ne vem, toda pokojni medijski in tehnološki filozof Marshall McLuhan je leta 1964 zapisal nekaj o tem, kako hitro nova priljubljenost televizije spreminja sodobno družbo, in imel je prav. Medij, je rekel McLuhan, je sporočilo. Format je vsebina.

Na primer, lahko napišete iste besede na Facebooku, Twitterju in LinkedInu in besede bodo v vsakem primeru imele drugačen pomen. Ker podcasti slavijo spontan in nenavajen človeški glas, je podcasting postal forum, kjer je mogoče zlahka pozdraviti in razumeti človeško ambivalentnost ali celo begajoče protislovje in ironijo. Predvidevam, da je to dober forum za pogovor o trendu, ki je zelo v novicah in o katerem imam veliko ambivalentnih in zmedenih misli, ki jih bom danes delil z vami. Govorim o umetni inteligenci.

Ko je leta 1964 Marshall McLuhan dejal, da je medij sporočilo, takrat, ko je le malo ljudi razmišljalo o subtilnih načinih, kako televizija in drugi intimni domači radiodifuzni mediji spreminjajo samo strukturo človeške družbe. Nov medij, ki ga omogoča današnja najsodobnejša tehnologija, grozi tudi z velikim družbenim vplivom. Govorim o priljubljenih splošnih orodjih umetne inteligence, kot je ChatGPT, ki so na voljo vsakomur z internetno povezavo – in če še niste slišali za ChatGPT, povsod dobiva veliko pozornosti zaradi tega, kako dobro posnema človeški pogovor in kako brez truda lahko integrira in pridobi celoten širok spekter razpoložljivega splošnega znanja.

Klepetalni roboti obstajajo že nekaj let – lahko so tako preprosti in neškodljivi kot prijazni avtomatizirani chatboti za pomoč uporabnikom na spletnem mestu BestBuy ali Ticketmaster. Novi chatboti, kot je ChatGPT4, po obsegu niso omejeni na elektronske izdelke ali vstopnice za koncerte – to so zelo različne vrste mehanizmov znanja, znani kot veliki jezikovni modeli, ki so usposobljeni za dojemanje celotne človeške inteligence.

Včasih ljudje mislijo, da je G v ChatGPT za General, in to bi bilo dobro ugibanje, ker je sistem zasnovan tako, da dokazuje splošno inteligenco in splošno znanje. G pravzaprav pomeni Generative, kar pomeni, da je ta izdelek zasnovan tudi za ustvarjanje stvari – za ustvarjanje izvirnih slik in besed. P pomeni pre-trained, o čemer bomo govorili čez nekaj minut, T pa pomeni Transformer, ki ni klasičen album Louja Reeda, temveč vzorec načrtovanja programske opreme, ki jezikovnemu modelu omogoča, da se odzove na vnesena besedila ne obdelavo ene besede naenkrat, vendar z upoštevanjem in izvajanjem transformacij na celotnem vnesenem besedilu kot celoti.

Ti novi chatboti se lahko pogovarjajo o kateri koli temi v prijaznem, medosebnem in niansiranem pogovornem slogu. Klepetalni roboti lahko pišejo eseje, rešujejo probleme, izvajajo globoka iskanja po bazah podatkov, ustvarjajo računalniško kodo in takoj odgovarjajo na težka vprašanja. ChatGPT in druge njemu podobne ponudbe kažejo raven jezikovne in celovite agilnosti, ki se zdi, da premika področje umetne inteligence naprej hitreje, kot smo mnogi od nas pričakovali, da bo to mogoče. Nedolgo nazaj je bila novica, da je nekaj osebja pri Googlu verjelo, da bi njihov sistem umetne inteligence lahko prestal Turingov test in postal neločljiv od čuteče človeške komunikacije, s čimer je s svojimi dokazi o zavesti prestrašil Googlove lastne strokovnjake. Ne vem, ali osebno verjamem, da lahko katera koli umetna inteligenca prestane Turingov test, vem pa, da mnogi strokovnjaki verjamejo, da je to postalo mogoče.

Klepetalni roboti splošnega znanja še zdaleč niso edini priljubljen primer uporabe umetne inteligence. Generatorji slik lahko takoj ustvarijo vizualna umetniška dela iz besedilnih pozivov – včasih osupljive, pametne slike, za ustvarjanje katerih bi fizični slikarji ali digitalni umetniki potrebovali ure ali dni ali tedne. Generiranje slik iz besedilnih pozivov je danes realnost prek brezplačnih spletnih generatorjev slik z umetno inteligenco, kot je DALL-E, iz OpenAI, istega podjetja iz Silicijeve doline, ki je ustvarilo ChatGPT. Lahko si zamislite idejo in opišete slog slikanja, ta spletna storitev pa vam čarobno pošlje kup različnih različic poskusov, da ujame vašo idejo.

To je danes realnost in prav tako je danes realnost, da lahko ChatGPT4 piše strokovne, premišljene in obsežne eseje o skoraj vsaki temi, o kateri ga vprašajo – eseje, ki bi lahko bili dovolj dobri, da si prislužijo visokošolsko diplomo.

Mogoče je še prezgodaj za takšno napoved, a zdi se, da inteligentni klepetalni roboti in generatorji slik – strojno ustvarjeno pisanje in strojno ustvarjena umetnost – predstavljajo veliko tehnološko in družbeno inovacijo, ki bo na en način vplivala na vse nas na zemlji. ali drugi. Kdo ve, v katero smer gre dandanes prihodnost, vendar se zdi vsaj možno, da se bo lansiranje ChatGPT3 leta 2022 nekoč spominjalo na pomemben trenutek v kulturni zgodovini, podoben lansiranju brskalnika Mosaic leta 1993, ki je zagnal celotno priljubljeno Internetni razmah, v katerem živimo še danes.

Prav tako se zdi možno, kar me moti, da bo ta nova inovacija povzročila nove vrste velikih težav, s katerimi se bomo vsi morali spoprijeti, čeprav mnogi od nas morda čutimo, da se naša družba že utaplja v neželenih posledicah druge tehnološke novosti, ki jih v življenju nismo zahtevali, jih nismo povabili v svoja življenja, pa vendarle so v naših življenjih.

To epizodo želim posvetiti pogovoru o tem, kako umetna inteligenca vpliva na nas kot protivojne aktiviste. Naj povem to takoj: AI je vroča tema, zelo kontroverzna in tako mora biti. To bi nas moralo skrbeti in o tem bi se morali pogovarjati, po mojem mnenju pa bi se morali tudi odpreti za dobro, ki ga ta tehnologija lahko naredi.

To je sporno med naprednimi in aktivisti in je sporno za vse. Moralo bi biti kontroverzno in te epizode ne bom delal, ker imam preproste odgovore o tem, kako lahko te nedavne inovacije vplivajo na naš planet. Vem, da bodo vplivale na naš svet, in vem, da morajo protivojni aktivisti govoriti o tem. Zato pripravljam to epizodo, da začnem pogovor, da razložim različna vprašanja, s katerimi se po mojem mnenju verjetno spopadajo številni protivojni aktivisti, ko govorijo o tej temi, in da morda izrazim nekaj razumevanja vseh strani tega zapletenega vprašanja. To je tisto, kar bom poskušal storiti tukaj – in ko boste končali s poslušanjem te epizode, delite svoje povratne informacije z našo world beyond war spletno stran za to epizodo ali pa me kontaktirate neposredno – zlahka me najdete.

Kar zadeva vpliv na vsakdanje življenje, se mnogi sprašujejo, ali bodo neverjetne zmogljivosti umetne inteligence pustile veliko ljudi brez dela. To je pogosto prva skrb, ki se pojavi ljudem, ko vidijo moč umetne inteligence. Ali bodo te napredne zmožnosti povzročile, da bodo različni sektorji dobrega zaposlovanja in prizadevanj nenadoma postali nezaželeni? Naša družba je že tako zelo neuravnotežena glede tega, kdo dela, kdo zasluži in kdo troši. Če bodo ekosistemi srednjega razreda, ki delajo za preživetje, dodatno moteni, ker lahko umetna inteligenca opravi veliko istih nalog bolje in brezplačno, smo lahko prepričani, da bo motnja povečala razkorak med premožnimi in ostalimi, da 1 % bo lahko imelo koristi od spremembe, medtem ko se bomo ostali soočali s posledicami, in da bo 1 % naredil tudi orodja AI, ki pomagajo 1 %, nena voljo ljudem, ki bi lahko koristili njihovo pomoč, ali pa bodo predraga za za dostop do njih.

Priznajmo si, v plenilskih kapitalističnih gospodarstvih, v katerih živimo mnogi od nas, brezposelnost pomeni zadolževanje in izgubo svobode izbire, in točno to je tisto, za kar so ta sociopatska trdnjavska gospodarstva namenjena običajnim ljudem – vzamejo nam moč po izbiri in nas prisilijo, da jih plačujemo in delamo zanje. To je vizija prihodnosti trdnjavskega kapitalizma danes: imeli bomo na novo inteligentne in zmogljive računalnike, saj smo sami obubožani.

Tu je tudi dejstvo, da policija in vojska že začenjata uporabljati orodja umetne inteligence, skupaj z novimi močnimi in nasilnimi roboti. Mislim, da je to morda trenutno najresnejša in neposredna grožnja, ki jo umetna inteligenca predstavlja, in mislim, da se protestna gibanja, ki jih oblega policija, kot je na primer pomembno gibanje Stop Cop City v Atlanti Georgia, že ukvarjajo s to spremenjeno realnostjo. Sistemi umetne inteligence nosijo pristranskosti in kodirane vrednote svojih človeških ustvarjalcev, zato policija ali vojska, usposobljena za umetno inteligenco, grozi, da bo postala dobesedni stroj za lov in ubijanje ranljivega prebivalstva, ki bo izbirala svoje tarče na podlagi videza ali rase. V svetu, ki že divja izpod nadzora zaradi vojne od Ukrajine do Jemna, je zamisel o opolnomočenju ene ali druge strani – in neizogibno obeh strani – z novimi vrstami ubijalskih strojev in režimov zatiranja, kodiranih s hudim rasnim profiliranjem, tako grozljiva kot zveni.

Najslabši možni scenariji množične brezposelnosti ali rasno kodirane umetne inteligence, ki jo uporabljajo policijske in vojaške sile, so grozljivi in o tem ne moremo spati, saj so učinki že v našem svetu. Se že dogaja. Zato začnimo ta pogovor s priznanjem, da sta dve od ločenih grozot, ki jih napredna umetna inteligenca predstavlja – množična brezposelnost in zloraba s strani policije in vojske – dva različna načina, kako močne sile utrjenega bogastva in privilegijev kradejo pravice in svoboščine ljudem. .

Ko smo že pri utrjenem bogastvu in privilegijih – pogovorimo se o OpenAI, podjetju v severni Kaliforniji, ki ga najdete na spletnem mestu OpenAI.com. To podjetje je bilo malo znano, dokler leta 2021 niso predstavili generatorja slik DALL-E, nato pa so novembra 2022, pred samo devetimi meseci, izdali svojega prvega javnega klepetalnika ChatGPT3, ki sta mu hitro sledila zmogljivejša in zmogljivejša ChatGPT3.5 in ChatGPT4 , različice, ki so zdaj na voljo.

Bil sem precej presunjen, ko sem prvič videl slike, ki jih lahko ustvari DALL-E, še bolj pa sem bil presunjen, ko sem prvič poskusil ChatGPT. Izziv, s katerim so se ta orodja poskušala soočiti, mi je bil zelo znan, saj sem tudi sam intenzivno študiral AI, tako kot mnogi razvijalci programske opreme. Moje prvo srečanje z umetno inteligenco je bil samostojni študijski projekt, ki sem ga opravljal na fakulteti pred kar nekaj desetletji.

To so bila osemdeseta leta prejšnjega stoletja in morda bodo nekateri zelo mladi presenečeni, ko bodo slišali, da so ljudje, kot sem jaz, delali z umetno inteligenco v osemdesetih letih prejšnjega stoletja, vendar je izraz umetna inteligenca star skoraj tako kot sama računalniška revolucija. Čeprav so bili dosežki umetne inteligence od petdesetih do devetdesetih let prejšnjega stoletja infantilni v primerjavi z napredkom, ki smo ga videli v letih od takrat.

Področje je bilo v osemdesetih letih tako odprto, da sem lahko dobil nekaj kreditnih točk v svojem zadnjem letniku na kombinirani smeri filozofije in računalništva, tako da sem pripravil izvirni neodvisni študijski projekt za program, ki bi razčlenjeval povedi v angleščini in se odzovejo na način, ki prikazuje ali simulira osnovno razumevanje. Kodiral sem v LISP na smešno zajetnem terminalu Unimatic, ki se sveti v zeleni barvi, povezanem z ogromnim glavnim računalnikom Univac, ki je bil velik kot velika stavba in je imel verjetno manj energije kot MacBook, na katerega snemam ta podcast, ker smo tako delali nazaj v 80. letih.

Razburljiv izziv mojega neodvisnega študijskega projekta z umetno inteligenco je bil razčleniti in odgovoriti na stavke, ki so vključevali preproste glagole in samostalnike. Na primer, v svoj program LISP bi vnesel stavke, kot so "Imam mačko z imenom Happy" in "moja mačka je oranžna" in "vse mačke rečejo mijavkati", kar bi pokazalo nekaj razumevanja z odgovori na vprašanja, kot je "je Happy oranžna?" ali "Ali Marcova mačka reče mijavkanje?". Dovolj zabavno je, da sem poskušal ustvariti klepetalni robot z umetno inteligenco kar tam na svojem glavnem računalniku Univac.

Stavim, da je veliko drugih študentov takrat poskušalo narediti isto, a nobeden od nas ni prišel daleč, ker so bila to leta 1980 in ena ključna briljantna ideja še ni prišla do nas: nevronska mreža, ki zagotavlja programsko opremo struktura, zasnovana za izvajanje masivno vzporednih preprostih operacij, podobnih nevronom v človeških možganih. Medtem ko je moj program LISP zagotavljal enonitno računanje, programi Fortran, COBOL in Pascal pa so sledili isti omejeni enonitni paradigmi, so nevronske mreže zagotavljale vzporedne elementarne niti, ki so vzporedno izvajale preproste izračune. Človeški možgani izvajajo ogromno vzporedne obdelave – sočasne operacije se kaskadirajo, da tvorijo iluzije singularnosti – in struktura programske opreme, znana kot nevronska mreža, bi koderjem omogočila, da izkoristijo moč te vzporedne obdelave – potem ko sem diplomiral na fakulteti.

Skupaj s konceptom nevronske mreže je sčasoma prišel koncept usposabljanja nevronske mreže s ponavljajočimi se aktivnostmi – še en koncept, ki nas v 80. letih še ni dosegel. Svojemu programu LISP sem dodajal majhno število celotnih stavkov in mu nisem dajal nobenih povratnih informacij, s katerimi bi lahko popravil in izboljšal njegovo delovanje. Namesto vnašanja stavkov v svoj računalniški terminal bi moral storiti to, da bi mu posredoval cele knjige, časopise in enciklopedije ter nenehno komuniciral z njim, da bi zagotovil povratne informacije o njegovem vedenju, saj je moj program vedno znova poskušal simulirati najosnovnejša, primitivna dejanja. razumevanja. S tem, ko sem mu dal veliko bralnega gradiva za izgradnjo bogate in zapletene baze znanja in ga ponavljajoče in temeljito uril, sem morda dejansko dosegel, da bi moj računalniški program rekel nekaj presenetljivega o tem, ali imam oranžno mačko ali ne. Izkazalo se je, da so nevronske mreže in ponavljajoče se usposabljanje pripomogli k uspešnim simulacijam človeške inteligence, ki jih danes vidimo pri chatbotih.

Opazili boste, da govorim o simulaciji človeške inteligence. To kaže na drugo polemiko. Nekaterim se zdi izraz »umetna inteligenca« smešen. Še huje kot smešno, nekaterim se zdi zamisel etično zaskrbljujoča, ker če inteligenca povzroči zavest, se lahko umetna inteligenca preoblikuje v umetno zavest – umetno čutenje, umetno samovoljnost, umetno pravico do obstoja. To zagotovo odpira številna eksistencialna vprašanja. Vsa ta vprašanja so veljavna in pomembna. Nekateri se sprašujejo, ali motorji znanja AI in jezikovni modeli morda že razvijajo zavest. Osebno se mi zdi precej enostavno izjaviti, da, ne, ni nam treba skrbeti, da bodo chatboti razvili dejanske občutke. Obstaja veliko različnih vidikov umetne inteligence, ki bi morali skrbeti, in to ni tisto, kar me osebno skrbi. Toda to ne pomeni, da lahko dokažem, da imam prav in da to nikogar ne sme skrbeti. Mogoče sem tako preobremenjen z različnimi stvarmi, ki bi me morale skrbeti, da nimam časa skrbeti za to. Nimam dokončnega odgovora na vsa vprašanja, ki se lahko pojavijo v zvezi z vprašanji čutnosti strojev, in ne bom se pretvarjal, da ga imam. Vendar vem, katera so vprašanja, s katerimi se moramo soočiti.

Eno mnenje, ki ga včasih slišim v aktivističnih skupnostih, je, da je umetna inteligenca le kup hype – iluzija, ki jo spodbujajo odlične pogovorne sposobnosti velikega jezikovnega modela. Seveda lahko GPT razčleni vprašanje in odgovori z elegantno frazeologijo, toda zakaj bi si zaradi te jezikovne sreče mislili, da je bil dosežen pomemben napredek? Google in Wikipedia sta že omogočila, da je celotno človeško znanje enostavno in brezplačno dostopno na internetu, na žalost Enciklopedije Britannice. Poslušamo ves ta hype o ChatGPT preprosto zato, ker predstavlja jezikovno fasado človeške zavesti, iluzijo, ki ji vsi tako nestrpno nasedamo. Mislim, da je tukaj nekaj veljave. Mogoče bi, če bi se Google ali Wikipedia prvotno začela tako nenadoma in v celoti oblikovati kot ChatGPT, morda govorili o lansiranju Googla ali Wikipedije kot o velikem napredku v kolektivni človeški inteligenci, ker sta oba že vplivala na naš svet.

Kljub temu, kot sem omenil zgoraj, ko sem govoril o nevronskih mrežah in usposabljanju, opisovanje velikih jezikovnih modelov kot fasad pomeni podcenjevanje plasti strukture programske opreme, ki mora obstajati, da bi omogočila to jezikovno srečo.

Tu je po mojem mnenju večje vprašanje: poglejmo etiko OpenAI in njegovih direktorjev, ustanoviteljev, vlagateljev in partnerjev. Tukaj je cel kup problemov.

OpenAI.com je zasebno financiran raziskovalni laboratorij, ki izhaja iz istega izjemno bogatega in razgibanega ekosistema tehnoloških inkubatorjev v Silicijevi dolini, ki nam je dal Facebook, Google, Microsoft, Amazon in Oracle. Njegovi ustanovitelji vključujejo Elona Muska, slavnega milijarderja, čigar sociopatske javne pripombe me res zmotijo skoraj tako kot mnoge druge ljudi. Elon Musk ni bil nikoli neposredno vpleten v OpenAI in prešel je k drugim stvarem, kot je prikazovanje svoje žaljive osebnosti po vseh družbenih medijih, tako da je to vse, kar želim danes povedati o Elonu Musku.

Po mojem mnenju je še bolj obsojajoče, da je OpenAI tesno povezan z Microsoftom, velikim vojnim dobičkarjem in velikim dobičkarjem na področju umetne inteligence za vojno. Upam, da bo ljudi skrbelo to zaskrbljujoče povezovanje, še bolj kot povezava z Elonom Muskom. Zelo bi nas moralo motiti, da je prijazen obraz DALL-E in OpenAI uporabna fasada za vsaj enega izjemno vplivnega in zlobnega vojnega dobičkarja, Microsoft, ki že razvija vrste rasno kodiranih vojaških in policijskih aplikacij umetne inteligence, o katerih smo govorili približno zgoraj. To se že dogaja v zakulisju Microsofta in drugih ameriških tehnoloških velikanov, ki so globoko povezani z ameriškim vojnim strojem. In to je približno najslabša novica, ki se je lahko spomnim.

Mi v protivojnem gibanju ne moremo obrniti hrbta umetni inteligenci zaradi njenega zlega potenciala. Seveda ne mislim, da morajo vsi v protivojnem gibanju dovoliti tehnološke posege v svoja življenja. Veseli me, da se mnogi progresivci in aktivisti pravilno odločijo, da se izognejo trendovskim tehnološkim inovacijam v svojih življenjih. Lahko se povežem s tem odnosom in ga spoštujem, čeprav sem daleč od življenjskega sloga brez tehnologije. Tehnologija je moje področje, moja kariera in kot tehnolog sem navdušen nad genijem, ustvarjalnostjo in inovativnostjo, ki stojijo za podvigi, kot je umetna inteligenca.

Poleg tega me kot radovedno osebo zelo zanima pridobivanje vpogleda v človeško inteligenco z učenjem o tem, kako so bili računalniki narejeni za njeno simulacijo. Prav tako dovolim ChatGPT v svoje življenje, ker sem odkril, kako uporaben je. Obiščem OpenAI.com in mu nenehno postavljam vprašanja. Uporabljam ChatGPT za pisanje kode, vključno z Javascriptom za novo različico našega interaktivnega zemljevida ameriških tujih vojaških baz, na katerem delam to poletje skupaj z drugimi ljudmi v World Beyond War.

Recimo, da želim počistiti parameter poizvedbenega niza tako, da odstranim posebne znake z regularnim izrazom, kar je nekaj, o čemer bi vprašal Stack Overflow, svojo delovno kodo pa bi sestavil iz priporočenih fragmentov, objavljenih v niti pogovora . Namesto tega zdaj ChatGPT povem, kaj hočem, in ChatGPT preprosto izpljune popolnoma oblikovan Javascript, izvedljiv in brez napak. Večina mojih prijateljev razvijalcev programske opreme zdaj uporablja ChatGPT za pisanje kode – vem, da jo uporabljamo, ker radi govorimo o tem. Mislim, da nikogar od nas koderjev še ne skrbi, da nas bo ChatGPT nadomestil, ker smo mi tisti, ki moramo sestaviti dele kode, da ustvarimo delujoče sisteme, GPT pa samo proizvaja dele kode. Vendar se sprašujem, kako bo to spremenilo način dela razvijalcev programske opreme. Vsekakor že spreminja igro.

ChatGPT uporabljam tudi za iskanje stvari v spletu, kot bi uporabljal Google, in ga uporabljam za pozive in perspektive ter osnovne informacije o stvareh, o katerih pišem ali razmišljam. Ne hecam se, ko rečem, da ga uporabljam za vse – tako kot ko sem zgoraj omenil tehnološkega filozofa iz šestdesetih let prejšnjega stoletja Marshalla McLuhana, seveda sem ChatGPT prosil za nekaj informacij o Marshallu McLuhanu in ChatGPT mi je povedal, da je bilo leto 1960 leto, ko je izdal knjigo, v kateri piše »medij je sporočilo«.

Dejstvo, da nas je toliko že prešlo z Googla na GPT za osnovno iskanje po internetu, pove veliko. Zelo enostavno je dovoliti tem novim vrstam orodij, da počasi in neopazno vstopijo v naša življenja, čeprav nas skrbijo posledice in motivacija za njimi.

Tako kot osnovna programska tehnologija interneta, ki jo je iz dvomljivih razlogov ustvarila ameriška vojska, vendar je povzročila družbene spremembe in našla nove primere uporabe, ki so bili popolnoma izven področja njenega prvotnega namena, bo ta nova tehnologija najti svojo pot do vplivanja na naša življenja. Ta nova tehnologija je resnična, deluje preveč dobro, da bi jo prezrli, in tukaj je, da ostane. Še enkrat, zato bom eno epizodo namenil pogovoru s protivojnimi aktivisti o tem – ker je to že del naše realnosti in morda bomo potrebovali nekaj moči, če bodo ponudbe, da bomo lahko opravili svoje delo tukaj na zemlji.

Vzemimo minuto za razmislek o številnih vidikih življenja na tem planetu, ki nimajo strašnih težav, ki se jih protivojni aktivisti tako zavedamo. Umetnost, glasba, literatura, biologija, kemija, fizika, geologija, astronomija, medicina, zdravje, proizvodnja, kmetijstvo, prehrana. V vseh teh svetovih, vseh teh prizadevanjih … ima javna uvedba zelo zmogljivega klepetalnega robota za splošno znanje velik vpliv. Ni polja, ki se ga ne dotakne.

Na ravni miroljubnega človeškega sobivanja – ravni, za katero si želim, da bi več časa preživel sam – je umetna inteligenca čudežni napredek človeških sposobnosti, ki obljublja velike koristi. Če bi le živeli v mirnem, varnem in pravičnem svetu, bi lahko skupaj bolje uživali v čudesih, ki jih lahko ustvari umetna inteligenca.

Nekatere od teh čudes opazimo, ko delamo z generatorjem slik in ustvarjamo osupljivo pametne ali ustvarjalne slike na podlagi lastnih pozivov, ki jih drugače ne bi mogli ustvariti. Čutimo tudi paradoks glede tega, ali je mogoče orodja umetne inteligence uporabiti za dobro ali ne. Kot strokovnjak verjamem, da tehnološke inovacije niso problem planeta Zemlje v 21. stoletju. Vedno pozdravljam tehnološke inovacije in mislim, da so nevarnosti, ki jih umetna inteligenca predstavlja, posledica utrjenega kapitalizma in vojne – dejstva, da je to planet v vojni s samim seboj, planet, ki mu prevladuje 1 % bogatih, ki se ne more upreti, da bi se postavil samomorilna pot gradnje militariziranih trdnjavskih družb, ki zatirajo druga človeška bitja, da bi ohranile privilegije. Kar moramo storiti, je ozdraviti našo družbo – česar pa nam ni treba storiti, je bežati pred tehnološkim napredkom, ker napačno razumemo vzroke naše agonije in naše samomorilne poti.

Tako mislim. Seveda ni to, kar misli vsak protivojni aktivist, in to je v redu. Imeli smo nekaj zanimivih odzivov na World Beyond War e-poštni seznam razprav – ki je živahen in inteligenten forum, ki se mu priporočam, da se pridruži vsem, preprosto kliknite povezavo na naši spletni strani ali poiščite world beyond war seznam razprav – potem ko je nekdo delil nekaj res domiselnih protivojnih slik, ki so bile ustvarjene z DALL-E, in nekdo drug je delil nekaj presenetljivo uporabnih besed o tem, kako lahko naš bolan planet najde poti do svetovnega miru.

Verjamem, da bi morali aktivisti obvladati vse razpoložljive tehnologije – da se aktivizem ne bi smel postaviti v položaj, da bi bil manj sposoben uporabljati napredne inovativne tehnologije kot skorumpirane vlade in pohlepne korporacije, ki nas imajo navado zatirati.

Prav tako verjamem, da lahko izberemo presenetljive filozofske resnice o človeški zavesti in človeškem obstoju s preučevanjem algoritmov in oblikovalskih vzorcev, ki se uporabljajo za njeno modeliranje in simulacijo. Že samo nekaj minut norčevanja s ChatGPT na spletni strani OpenAI lahko razkrije nekaj divjih resnic o človeški naravi.

Tukaj je ena divja stvar, o kateri še vedno razmišljam. ChatGPT včasih laže. To naredi stvari. Tega običajno ne boste videli, ko začnete spraševati GPT, ker bo običajno ponudil močan odgovor na prvo vprašanje v pogovorni niti. GPT je nato v koraku z vami, ko postavljate nadaljnja vprašanja, in tukaj je mogoče vrniti GPT v kot, kjer začne ležati naravnost navzgor. Eno prvih vprašanj, ki sem jih kdaj zastavil ChatGPT, je bilo, naj mi pove o najboljših protivojnih podcastih, ker je bil seveda moj ego angažiran in želel sem videti, ali World Beyond War podcast bi se prikazal na seznamu.

Zdaj, ker je GPT vnaprej usposobljen – to pomeni, da je bil vnaprej usposobljen in se ne napaja več aktivno z zelo aktualnimi novicami in informacijami, zato ne bi pričakoval, da bo vedel veliko o moji mali podcast. Prav tako nisem želel izkrivljati rezultatov s tem, da bi GPT pokazal, da me zanima določen podcast, zato sem ga vprašal, ali obstajajo odlični protivojni podcasti, in zagotovil mi je, da res obstajajo. Nato sem se začel spuščati v podrobnosti v upanju, da ga bom spodbudil k imenu World Beyond War podcast z vprašanjem – mi lahko poveste o podcastih, v katerih so bili intervjuji z znanimi aktivisti, kot je Medea Benjamin. Tukaj začnejo stvari postajati smešne. Ko sistem izda zahtevek, bo poskusil podpreti zahtevek, tako da, potem ko mi je zagotovil, da res obstajajo podcasti, ki so intervjuvali Medeo Benjamin, sem ga prosil, naj poimenuje enega od teh podcastov, nato pa mi je povedal, da je Medea Benjamin voditeljica lastnega podcasta. Hm, ni! Če bi bila, bi jo zagotovo poslušal. ChatGPT mi je uspelo pripraviti do laži tako, da sem ga postavil v kot, kjer je moral zagotoviti informacije, ki jih ni imel, tako da si je izmislil informacije, ki so zvenele realistično.

To se zgodi pogosteje, kot bi si kdo mislil. ChatGPT lahko tudi zlahka ujamete v napaki, tako da mu vržete resnične, a protislovne informacije. Potem ko me je GPT pravilno obvestil, da je Marshall McLuhan leta 1964 uvedel citat »Medij je sporočilo«, sem se spomnil, da je ta briljanten in oster filozof napisal tudi nekakšno ironično nadaljevanje svoje prejšnje knjige, ki je obravnavala temnejše in bolj zaskrbljujoče načini, kako lahko mediji uspavajo človeške misli, strašljive populacije korporativnega množičnega nadzora prebivalstva prek medijev – ker je bil Marshall McLuhan res tako osupljiv, je to nevarnost razumel že v šestdesetih letih prejšnjega stoletja in leta 1960 z umetnikom Quentinom Fiorejem objavil drugo knjigo imenovano »Medij je masaža«.

Tukaj so torej stvari postale čudne z GPT. ChatGPT sem prosil, naj mi pove o citatu Marshalla McLuhana »medij je masaža« … in GPT me je odločno obvestil, da McLuhan ni rekel »medij je masaža«, temveč je rekel »medij je sporočilo«. Jasno je, da je GPT mislil, da je masaža tipkarska napaka. Nato sem obvestil GPT, da je bilo napačno in da je McLuhan res rekel tako "medij je sporočilo" kot "medij je masaža". Takoj ko sem to rekel, je ChatGPT spoznal svojo napako, se opravičil in me obvestil, da je knjiga, ki jo je napisal leta 1967, "medij je masaža".

Zakaj se je torej najprej zmotilo in predvsem zakaj se je zmotilo, ko je že imelo dostop do pravega odgovora na dosegu roke? No, tukaj GPT začenja razkrivati presenetljive resnice o nas samih, ker sta v resnici dve napaki ali neprimernem vedenju GPT naredili, da se zdi bolj človeško, ne manj. Ne pozabite, da G v GPT pomeni generativno. Sistem je zasnovan tako, da ustvari odgovore, ko ni prepričan o pravilnem odgovoru. Morda vam pove naslov filma ali knjige, ki ne obstaja – vendar bo to naslov, za katerega se zdi, da bi lahko obstajal. Če imate odprt, dolg pogovor s ChatGPT o kateri koli temi, o kateri veste veliko, boste hitro videli, da začne delati napake.

Način, kako mi je uspelo GPT spraviti v kot, tako da sem mu postavljal vprašanja, ki spremljajo njegove lastne odgovore, s čimer sem sčasoma povzročil, da je ustvaril realistične navidezne, a napačne informacije, da bi podprl svoje prejšnje izjave, se mi ni zdel nečloveški, ampak povsem človek.

Tu vidimo ostro moč retoričnih in manipulativnih stilov argumentiranja. Morda se lahko iz tega presenetljivega napačnega vedenja ChatGPT naučimo, da je človeško nemogoče dojeti resnico brez izmišljevanja resnic na tak ali drugačen način, in če nismo previdni, lahko te izmišljene resnice, ki jih uporabljamo v retorične namene, postanejo laži, ki jih prisiljen braniti z več izmišljotinami. Fant, to se mi zagotovo zdi resnično.

Še bolj resnično: vemo, da človeško podobno vedenje ChatGPT vključuje laganje. Pa vendar ji zaupamo! Tudi sam ga še naprej uporabljam, ker sem v resnici dovolj samozavesten, da verjamem, da bom vedno lahko zaznal, kdaj se GPT trudi za odgovor in generira lažne informacije. Hej, morda se hecam in morda bi moral razmisliti o svoji nagnjenosti, da verjamem izmišljenim resnicam, in o svoji nagnjenosti, da drugim omogočim laž.

Tukaj je način, na katerega nas GPT naredi pametnejše, saj pokaže na načine, kako se ukvarjamo z neresnico in fasadami ter belimi lažmi in prijateljskimi prevarami v naših običajnih človeških odnosih. Če na kratko povem: ChatGPT ne more simulirati človeškega vedenja, ne da bi včasih lagal. To je hudiča stvar, o kateri moramo vsi razmišljati.

Tukaj je še nekaj za razmislek: kako gre nam ljudem v smislu dohajanja tehnoloških inovacij, ki opredeljujejo naše družbe? V zadnjih nekaj letih se prilagajamo napredku umetne inteligence, hkrati pa prevzemamo izum blockchaina, nove tehnološke metode za gradnjo skupnih baz podatkov z novimi koncepti lastništva, dostopa in potrjevanja. Prejšnjo epizodo smo posneli vse o blockchainu in osebno sem prepričan, da večina ljudi, ki jih poznam, še vedno ne razume, kako blockchain spreminja naša življenja in kako bo spreminjal naša življenja v prihodnosti – in zdaj imamo širok jezik modeli in motorji splošnega znanja, ki bodo spremenili naša življenja in tudi našo prihodnost! Daj to na vrh, hmm … kam naj grem tukaj … projekt človeškega genoma, ogromen napredek v znanosti o možganih, raziskovanje in kolonizacija vesolja … hej, soljudje, ali dohajamo vse to?

Zdaj pa se vrzimo k tehnološkim in znanstvenim sporom o pandemijah, kot je COVID, in ne počivajmo pri tem, ampak nadaljujmo z razmislekom o razmerah široko dostopnega jedrskega orožja v rokah skorumpiranih in nesposobnih tako imenovanih vlad, ki jih vodijo ostareli birokrati, in politike vzajemno zagotovljenega uničenja.

Ali temu sledimo? Ne, toda to sranje je v koraku z nami in ima našo številko. Vsako jutro se zbudim in berem o posredniški vojni med Natom in Rusijo, ki tragično ubija uboga človeška bitja, ki živijo v Ukrajini. In vsako jutro se sprašujem, ali je to dan, ko bo nesposobnost naših tako imenovanih voditeljev povzročila začetek jedrske vojne – vsak dan se sprašujem, ali je to zadnji dan za človeško življenje na planetu Zemlja.

Vroče poletje 2023 je. Na sporedu je nov film z naslovom »Oppenheimer« o znanstveniku, čigar delo je privedlo do neverjetne groze takojšnjega umora na stotisoče ljudi v Hirošimi in Nagasakiju na Japonskem leta 1945. Mislim, da kdorkoli od nas je še uspel dovolj razširiti svoj um, da bi razumel absolutno zlo, šokantne, nevzdržne resnice o napakah, ki so jih naredile naše družbe – in o našem neuspehu, da bi se izboljšali in dvignili iz naše patetične, sramotne družbene odvisnosti od množično sovraštvo in množično nasilje.

Zgoraj sem omenil, da se nekateri sprašujejo, ali lahko umetna inteligenca vodi do zavesti in/ali občutka – ali lahko sistem AI kdaj razvije čustva in občutke ter kaj te besede in ta vprašanja sploh pomenijo. Nisem še videl filma Oppenheimer in počutim se precej slabo ob ideji o filmu o množičnih umorih na Japonskem, ki ne prikazuje obrazov japonskih žrtev. Namesto da bi se spraševal, ali so sistemi umetne inteligence čuteči ali ne, želim samo povedati, da je bila vsaka oseba, sežgana v Hirošimi in Nagasakiju, čuteča in pri zavesti. To je resnica, s katero mislim, da se nam še ni uspelo soočiti. Mogoče moramo še malo bolj trenirati svoj um o tem.

In tu danes zaključujemo. Ljudje ne moremo sprejeti resnice o težavah, ki smo jih ustvarili, in spremembah, ki jih moramo narediti, da bi se izboljšali. Tudi roboti ne prenesejo resnice. Hvala, ker si delil ta prostor z menoj, ko razmišljam o skrivnostih in ironijah človeškega obstoja, in popeljal naju bom s človeškim glasom pevke in tekstopisca, ki jo ljubim že dolgo, Sinead O'Connor, in pesem z naslovom The Healing Room. Hvala, ker ste poslušali 50. epizodo. Kmalu se vidimo nazaj na 51.

World BEYOND War Podcast na iTunes

World BEYOND War Podcast na Spotify

World BEYOND War Podcast na Stitcherju

World BEYOND War Podcast RSS Feed