Por Marc Eliot Stein, World BEYOND War, 31 de julio de 2023

Esta es una transcripción completa del Episodio 50 de World BEYOND War: un nuevo podcast.

Es julio, el caluroso verano de 2023. Sabes quién soy, soy Marc Eliot Stein, director de tecnología de World Beyond War, todavía aquí en las tierras de Lanape de Brooklyn Nueva York, todavía haciendo lo correcto aquí en el World Beyond War Podcast, Excepto que hoy es especial porque este es el episodio 50, wow, un número redondo.

Cuando comencé este podcast, creo que ni siquiera pensé si llegaría o no a los 50 episodios. El número 50 seguramente no habría parecido realista en ese momento. Supongo que principalmente me preguntaba si alguna vez completaría el episodio número 1, y hubo algunas llamadas cercanas a rendirme antes de hacerlo.

Y aquí estoy a los 50, y qué alegría es darme cuenta de que descubrimos cómo hacer que este podcast contra la guerra realmente funcione y encontramos una audiencia que crece cada mes. Estoy muy orgullosa de este podcast y estoy agradecida con todos los que han sido parte de él hasta ahora.

El podcasting es un formato creativo único. No es como cualquier otra cosa. Lo sé porque yo también soy un adicto a los podcasts. Tengo al menos 20 programas regulares que realmente me interesan: sobre historia, política, tecnología, música, literatura, televisión, películas. Cuando estoy de humor para relajarme y ampliar mis conocimientos al mismo tiempo, realmente no hay otro formato que funcione como lo hace un podcast. Creo que esta es una distinción importante: ponga a un anfitrión y a un invitado en un seminario web, por ejemplo, o en un chat transmitido en vivo, y tendrán un tipo de conversación, pero si pone a las mismas dos personas en una entrevista de podcast, de alguna manera Tendré un tipo diferente de conversación, probablemente más personal, más espontánea, más incoherente, más en el momento, menos diseñada para llegar a una conclusión.

¿Por qué es esto exactamente? No lo sé, pero el difunto filósofo de los medios y la tecnología Marshall McLuhan escribió algo en 1964 sobre la rapidez con que la nueva popularidad de la televisión estaba cambiando la sociedad moderna, y tenía razón. El medio, dijo McLuhan, es el mensaje. El formato es el contenido.

Por ejemplo, podría escribir las mismas palabras en Facebook, Twitter y LinkedIn, y las palabras tendrán un significado particular diferente en cada caso. Dado que los podcasts celebran la voz humana espontánea y no ensayada, el podcasting se ha convertido en un foro donde la ambivalencia humana o incluso las contradicciones e ironías desconcertantes pueden ser fácilmente acogidas y comprendidas. Supongo que este es un buen foro para hablar sobre una tendencia que está muy presente en las noticias y sobre la cual tengo muchos pensamientos ambivalentes y desconcertantes a punto de compartir con ustedes hoy. Estoy hablando de inteligencia artificial.

Cuando Marshall McLuhan dijo que el medio es el mensaje en 1964, cuando pocas personas pensaban en las formas sutiles en que la televisión y otros medios íntimos de transmisión desde el hogar estaban cambiando la estructura misma de la sociedad humana. Hoy, un nuevo medio habilitado por la tecnología más actualizada también amenaza con tener un gran impacto social. Me refiero a las herramientas populares de IA de uso general como ChatGPT, que están disponibles para cualquier persona con conexión a Internet, y si no ha oído hablar de ChatGPT, está recibiendo mucha atención en todas partes debido a lo bien que emula la conversación humana. y con qué facilidad puede integrar y recuperar todo el amplio espectro del conocimiento general disponible.

Los chatbots existen desde hace algunos años; pueden ser tan simples e inocuos como los amigables chatbots automatizados de servicio al cliente en un sitio web de BestBuy o Ticketmaster. Los nuevos chatbots como ChatGPT4 no se limitan en su alcance a productos electrónicos o entradas de conciertos: estos son tipos muy diferentes de motores de conocimiento, conocidos como grandes modelos de lenguaje, entrenados para captar la totalidad de la inteligencia humana.

A veces, las personas piensan que la G en ChatGPT es para General, y esta sería una suposición decente, porque el sistema está diseñado para demostrar inteligencia general y conocimiento general. La G en realidad significa Generativo, lo que significa que este producto también está diseñado para crear cosas, para generar imágenes y palabras originales. La P significa pre-entrenado, de lo que hablaremos en unos minutos, y la T es para Transformer, que no es un álbum clásico de Lou Reed sino un patrón de diseño de software que permite que el modelo de lenguaje responda a los textos ingresados no por procesando una palabra a la vez, sino considerando y ejecutando transformaciones en todo el texto ingresado como un todo.

Estos nuevos chatbots pueden conversar sobre cualquier tema en un estilo de conversación amistoso, interpersonal y matizado. Los chatbots pueden escribir ensayos, resolver problemas, realizar búsquedas profundas en bases de datos, generar código de computadora, responder instantáneamente preguntas difíciles. ChatGPT y otras ofertas similares muestran un nivel de agilidad lingüística e integral que parece hacer avanzar el campo de la inteligencia artificial más rápido de lo que muchos de nosotros esperábamos. No hace mucho tiempo, hubo una noticia que decía que algunos miembros del personal de Google creían que su propio sistema de inteligencia artificial podía pasar la prueba de Turing y volverse indistinguible de la comunicación humana inteligente, lo que asustó a los propios expertos de Google con su evidencia de conciencia. No sé si personalmente creo que cualquier IA puede pasar la prueba de Turing, pero sé que muchos expertos ahora creen que esto se está volviendo posible.

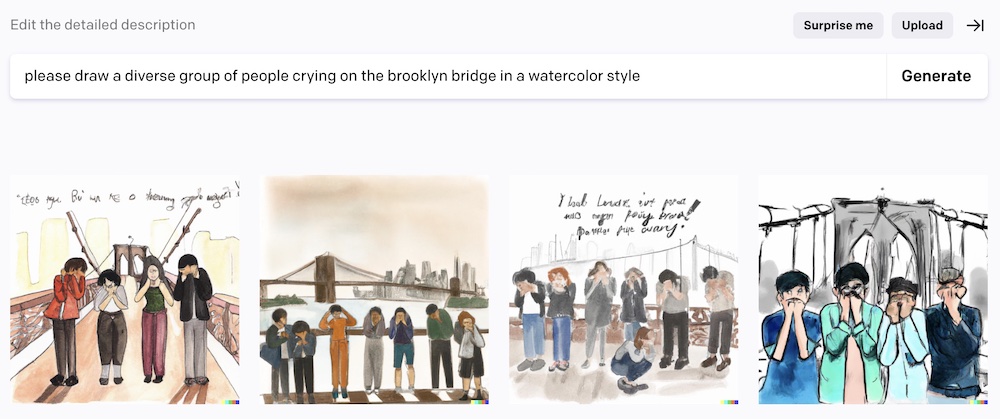

Los chatbots de conocimiento general están lejos de ser el único caso de uso popular para la IA. Los generadores de imágenes pueden crear instantáneamente obras de arte visuales a partir de indicaciones de texto, a veces imágenes sorprendentes e inteligentes que los pintores físicos o los artistas digitales tardarían horas, días o semanas en crear. La generación de imágenes a partir de indicaciones de texto es una realidad hoy en día a través de generadores de imágenes de inteligencia artificial gratuitos en línea como DALL-E, de OpenAI, la misma empresa de Silicon Valley que creó ChatGPT. Puede imaginar una idea y describir un estilo de pintura y este servicio web le envía mágicamente un montón de diferentes variaciones de intentos de capturar su idea.

Esta es una realidad hoy en día, y también es una realidad hoy en día que ChatGPT4 puede escribir ensayos completos, reflexivos y extensos sobre casi cualquier tema sobre el que se les pregunte, ensayos que podrían ser lo suficientemente buenos para obtener títulos universitarios avanzados.

Tal vez sea demasiado pronto para hacer una predicción como esta, pero parece que los chatbots inteligentes y los generadores de imágenes (escritura generada por máquinas y arte generado por máquinas) representan una importante innovación tecnológica y una gran innovación social que nos afectará a todos en la Tierra de una manera. u otro. Quién sabe hacia dónde se dirige el futuro en estos días, pero parece al menos posible que el lanzamiento de ChatGPT3 en 2022 algún día sea recordado como un momento significativo en la historia cultural similar al lanzamiento del navegador Mosaic en 1993, que inició todo el popular El auge de Internet que aún vivimos hoy en día.

También parece posible, me inquieta decirlo, que esta nueva innovación cause nuevos tipos de problemas importantes con los que todos tendremos que enfrentarnos, aunque muchos de nosotros podamos sentir que nuestra sociedad ya se está ahogando en los efectos secundarios no deseados de otras innovaciones tecnológicas que no solicitamos en nuestras vidas, no invitamos a nuestras vidas y, sin embargo, están en nuestras vidas de todos modos.

Quiero pasar este episodio hablando de cómo la IA nos afecta como activistas contra la guerra. Permítanme decir esto desde el principio: la IA es un tema candente, muy controvertido, y así es como debería ser. Deberíamos estar preocupados por eso y deberíamos estar hablando de eso, y en mi opinión también deberíamos abrir nuestras mentes al bien que esta tecnología puede hacer.

Es controvertido entre progresistas y activistas y es controvertido para todos. Debería ser controvertido, y no estoy haciendo este episodio porque tengo respuestas fáciles sobre cómo estas innovaciones recientes pueden afectar nuestro planeta. Sé que tendrán un impacto en nuestro mundo, y sé que los activistas contra la guerra deben hablar de ello. Así que estoy haciendo este episodio para iniciar la conversación, para exponer los diversos problemas con los que creo que muchos activistas contra la guerra probablemente están luchando cuando hablan sobre este tema, y tal vez para expresar cierta comprensión de todos los lados de este desconcertante asuntos. Eso es lo que intentaré hacer aquí, y cuando termine de escuchar este episodio, comparta sus comentarios en nuestro world beyond war página web para este episodio, o poniéndose en contacto conmigo directamente, soy fácil de encontrar.

En términos de impacto en la vida cotidiana, muchos se preguntan si las asombrosas capacidades de la inteligencia artificial dejarán sin trabajo a muchas personas. Esta suele ser la primera preocupación que se les ocurre a las personas cuando ven el poder de la IA. ¿Estas capacidades avanzadas harán que varios sectores de empleo y esfuerzo humanos saludables se vuelvan repentinamente no deseados? Nuestra sociedad ya está muy desequilibrada en términos de quién trabaja, quién gana y quién gasta. Si los ecosistemas de clase media en los que trabaja para ganarse la vida se interrumpen aún más porque la IA puede hacer muchas de las mismas tareas mejor y de forma gratuita, podemos estar seguros de que la interrupción aumentará la brecha entre los ricos y el resto de nosotros, que el 1 % podrá beneficiarse del cambio mientras que el resto de nosotros debe enfrentar las consecuencias, y que el 1 % también hará que las herramientas de IA que ayuden al 1 % no estén disponibles para las personas que podrían usar su ayuda, o sean demasiado caras para ellos para acceder.

Seamos realistas, en las economías capitalistas depredadoras en las que muchos de nosotros estamos atrapados viviendo, el desempleo significa endeudarse y perder nuestra libertad de elección, y esto es exactamente lo que estas economías de fortaleza sociópatas están diseñadas para hacerle a la gente normal: quitarnos el poder. de elección y hacer que les paguemos y trabajemos para ellos. Esta es la visión futura del capitalismo de fortaleza actual: tendremos computadoras nuevas, inteligentes y poderosas, ya que nosotros mismos estamos empobrecidos.

También está el hecho de que la policía y el ejército ya están comenzando a utilizar herramientas de inteligencia artificial, junto con nuevos robots poderosos y violentos. Creo que esta puede ser la amenaza más grave e inmediata que presenta AI en este momento, y creo que los movimientos de protesta asediados por la policía como, por ejemplo, el importante movimiento Stop Cop City en Atlanta, Georgia, ya están lidiando con esta realidad cambiada. Los sistemas de IA tienen los sesgos y los valores codificados de sus creadores humanos, por lo que la policía o el ejército entrenados por IA amenazan con convertirse literalmente en máquinas de caza y muerte para las poblaciones vulnerables, eligiendo sus objetivos en función de la apariencia o la raza. En un mundo que ya está fuera de control con la guerra desde Ucrania hasta Yemen, la idea de empoderar a un lado u otro, e inevitablemente a ambos lados, con nuevos tipos de máquinas asesinas y regímenes de represión codificados con perversos perfiles raciales es tan horrible como suena.

Los peores escenarios de desempleo masivo o inteligencia artificial codificada racialmente utilizada por la policía y las fuerzas militares son horribles, y no podemos dormir con esto porque los efectos ya están en nuestro mundo. Ya está sucediendo. Entonces, comencemos esta conversación reconociendo que dos de los horrores separados que la IA avanzada parece presentar (el desempleo masivo y el abuso por parte de la policía y las fuerzas militares) son dos formas diferentes en que las fuerzas poderosas de la riqueza y el privilegio arraigados roban los derechos y las libertades de las personas. .

Hablando de riqueza y privilegios arraigados, hablemos de OpenAI, una empresa del norte de California que puede encontrar en línea en OpenAI.com. Esta empresa era poco conocida hasta que lanzaron el generador de imágenes DALL-E en 2021, y luego, en noviembre de 2022, hace solo nueve meses, lanzaron su primer chatbot público, ChatGPT3, seguido rápidamente por los más potentes y capaces ChatGPT3.5 y ChatGPT4. , las versiones disponibles ahora.

Me impresionó bastante la primera vez que vi las imágenes que DALL-E podía crear, y me impresionó aún más la primera vez que probé ChatGPT. El desafío que estas herramientas intentaban enfrentar me resultaba muy familiar, porque yo mismo había estudiado intensamente la IA, al igual que muchos desarrolladores de software. Mi primer encuentro con la inteligencia artificial fue un proyecto de estudio independiente que hice en la universidad, hace bastantes décadas.

Esto fue en la década de 1980, y tal vez algunas personas muy jóvenes se sorprendan al saber que personas como yo estaban trabajando en IA en la década de 1980, pero el término inteligencia artificial es casi tan antiguo como la propia revolución informática. Aunque los logros de la IA desde la década de 1950 hasta la década de 1990 fueron infantiles en comparación con los avances que hemos visto en los años posteriores.

El campo era tan abierto en los años 80, de hecho, pude obtener algunos créditos durante mi último año como estudiante combinado de Filosofía y Ciencias de la Computación al preparar un proyecto de estudio independiente original para un programa que analizaría oraciones en inglés y responder de una manera que demuestre o simule una comprensión básica. Codifiqué en LISP en una terminal Unimatic con un brillo verde hilarantemente voluminoso conectado a un mainframe Univac masivo que era del tamaño de un edificio grande y probablemente tenía menos energía que la MacBook en la que estoy grabando este podcast en este momento, porque así es como rodamos allá por los años 80.

El emocionante desafío de mi proyecto de estudio independiente de IA fue analizar y responder oraciones que incluían verbos y sustantivos simples. Por ejemplo, escribiría oraciones como "Tengo un gato llamado Happy" y "mi gato es naranja" y "todos los gatos dicen miau" en mi programa LISP, lo que demostraría cierta comprensión al responder preguntas como "¿Feliz es naranja?" o “¿el gato de Marc dice miau?”. Curiosamente, estaba tratando de crear un chatbot de IA allí mismo en mi mainframe Univac.

Apuesto a que muchos otros estudiantes universitarios estaban tratando de hacer lo mismo en ese momento, pero ninguno de nosotros llegó muy lejos, porque estábamos en la década de 1980 y una idea brillante clave aún no nos había llegado: la red neuronal, que proporciona un software estructura diseñada para llevar a cabo operaciones simples masivamente paralelas similares a las neuronas en el cerebro humano. Mientras que mi programa LISP proporcionaba cómputo de subproceso único, y los programas Fortran, COBOL y Pascal seguían el mismo paradigma limitado de subproceso único, las redes neuronales proporcionaban subprocesos elementales paralelos que realizaban cálculos simples en paralelo. El cerebro humano realiza una gran cantidad de procesamiento paralelo (operaciones simultáneas en cascada para formar ilusiones de singularidad) y la estructura de software conocida como red neuronal permitiría a los codificadores aprovechar el poder de este procesamiento paralelo después de graduarme de la universidad.

Junto con el concepto de red neuronal, finalmente surgió el concepto de entrenar una red neuronal con actividades repetitivas, otro concepto que aún no había llegado a nosotros en los años 80. Estaba alimentando mi programa LISP con una pequeña cantidad de oraciones completas y no le estaba dando ningún comentario con el que corregir y mejorar su rendimiento. Lo que debería haber estado haciendo, en lugar de escribir oraciones en mi terminal de computadora, era alimentarlo con libros, periódicos y enciclopedias completos, e interactuar constantemente con él para proporcionar retroalimentación a su comportamiento mientras mi programa intentaba repetidamente simular los actos más básicos y primitivos. de comprension Al darle mucho material de lectura para construir una base de conocimiento rica y compleja y entrenarlo de manera repetitiva y exhaustiva, podría haber logrado que mi programa de computadora dijera algo sorprendente sobre si tenía o no un gato naranja. Resulta que las redes neuronales y el entrenamiento repetitivo ayudaron a abrir el camino hacia las simulaciones exitosas de la inteligencia humana que vemos hoy en día con los chatbots.

Notarás que hablo de simular la inteligencia humana. Esto apunta a otra controversia. Algunas personas encuentran ridículo el término "inteligencia artificial". Peor que ridículo, algunos encuentran la idea éticamente preocupante porque, si la inteligencia da lugar a la conciencia, la inteligencia artificial puede transformarse en conciencia artificial: sensibilidad artificial, obstinación artificial, derecho artificial a existir. Seguro que esto plantea muchas preguntas existenciales. Todas estas preguntas son válidas e importantes. Algunos se preguntan si los motores de conocimiento de IA y los modelos de lenguaje ya podrían estar desarrollando conciencia. Personalmente, me resulta bastante fácil declarar que no, no tenemos que preocuparnos de que los chatbots desarrollen sentimientos reales. Hay muchos aspectos diferentes de la IA de los que preocuparse, y este no es uno que me preocupe personalmente. Pero eso no significa que pueda demostrar que tengo razón y que nadie debería preocuparse por eso. Tal vez estoy tan abrumado por diferentes cosas de las que debería preocuparme que no tengo tiempo para preocuparme por esta. No tengo una respuesta definitiva a todas las preguntas que puedan surgir sobre la sensibilidad de las máquinas, y no voy a fingir que la tengo. Pero sí sé cuáles son las preguntas que debemos descubrir cómo enfrentar.

Una opinión que a veces escucho dentro de las comunidades activistas es que la IA equivale a un montón de exageraciones, una ilusión fomentada por las excelentes habilidades de conversación de un modelo de lenguaje grande. Claro, GPT puede analizar una pregunta y responder con una fraseología elegante, pero ¿por qué esta felicidad con el lenguaje nos haría imaginar que se ha logrado algún avance significativo? Google y Wikipedia ya hicieron que todo el conocimiento humano estuviera fácilmente disponible de forma gratuita en Internet, para consternación de la Enciclopedia Británica. Estamos escuchando todo este bombo sobre ChatGPT simplemente porque presenta una fachada lingüística de la conciencia humana, una ilusión de la que todos nos enamoramos con tanto entusiasmo. Creo que hay algo de validez aquí. Tal vez si Google o Wikipedia se hubieran lanzado originalmente de la forma repentina y completamente formada que lo hizo ChatGPT, tal vez estaríamos hablando del lanzamiento de Google o Wikipedia como avances masivos en la inteligencia humana colectiva, porque ambos ya han impactado nuestro mundo.

Aún así, como mencioné anteriormente cuando hablé sobre redes neuronales y entrenamiento, describir modelos de lenguaje grandes como fachadas es subestimar las capas de estructura de software que deben existir para hacer posible esta felicidad lingüística.

Aquí hay una pregunta más importante, en mi opinión: analicemos la ética de OpenAI y sus directores, fundadores, inversores y socios. Aquí hay un montón de problemas.

OpenAI.com es un laboratorio de investigación financiado con fondos privados que surge del mismo ecosistema de incubadoras de tecnología de Silicon Valley ultra rico y de alto rendimiento que nos dio Facebook, Google, Microsoft, Amazon y Oracle. Entre sus fundadores se encuentra Elon Musk, el famoso multimillonario cuyos comentarios públicos sociópatas realmente me enferman tanto como enferman a muchas otras personas. Elon Musk nunca estuvo directamente involucrado en OpenAI, y pasó a otras cosas como mostrar su personalidad ofensiva en todas las redes sociales, así que eso es todo lo que quiero decir sobre Elon Musk hoy.

De la forma en que lo veo, es aún más condenatorio que OpenAI esté estrechamente involucrado con Microsoft, un importante especulador de la guerra y un importante especulador en el campo de la inteligencia artificial para la guerra. Esta asociación preocupante es lo que espero que la gente se preocupe, incluso más que la conexión con Elon Musk. Debería estar muy preocupado de que la cara amistosa de DALL-E y OpenAI sea una fachada útil para al menos un especulador de guerra malvado y enormemente influyente, Microsoft, que ya está desarrollando los tipos de aplicaciones de inteligencia artificial militares y policiales codificadas racialmente de las que hablamos. sobre arriba. Esto ya está sucediendo detrás de escena en Microsoft y otros gigantes tecnológicos de EE. UU. que están profundamente vinculados a la maquinaria de guerra de EE. UU. Y esta es la peor noticia que se me ocurre.

Nosotros en el movimiento contra la guerra no podemos darle la espalda a la inteligencia artificial debido a su potencial maligno. No quiero decir, por supuesto, que todo el mundo en el movimiento contra la guerra necesite permitir las invasiones tecnológicas en sus propias vidas. Me alegra que muchos progresistas y activistas tomen una decisión válida para evitar las innovaciones tecnológicas de moda en sus vidas. Puedo relacionarme y respetar esta actitud, aunque yo mismo estoy lejos de tener un estilo de vida libre de tecnología. La tecnología es mi campo, mi carrera y, como tecnólogo, me fascina la genialidad, la creatividad y la innovación detrás de iniciativas como la inteligencia artificial.

Además, simplemente como una persona curiosa, estoy absolutamente interesado en obtener información sobre la inteligencia humana aprendiendo cómo se han fabricado las computadoras para simularla. También permito que ChatGPT entre en mi vida porque descubrí lo útil que es. Voy a OpenAI.com y le hago preguntas constantemente. Uso ChatGPT para escribir código, incluido Javascript para una nueva versión de nuestro mapa interactivo de bases militares extranjeras de EE. UU. en el que estoy trabajando este verano junto con otras personas en World Beyond War.

Digamos que quiero limpiar un parámetro de cadena de consulta eliminando caracteres especiales con una expresión regular, que es algo sobre lo que habría preguntado a Stack Overflow, y juntaría mi código de trabajo a partir de fragmentos recomendados publicados en un hilo de conversación . En cambio, ahora le digo a ChatGPT lo que quiero, y ChatGPT simplemente escupe Javascript perfectamente formateado, ejecutable y sin errores. La mayoría de mis amigos desarrolladores de software usan ChatGPT para escribir código ahora; sé que lo hacemos porque nos gusta hablar de eso. No creo que ninguno de nosotros, los codificadores, estemos preocupados todavía de que ChatGPT nos reemplace, porque somos nosotros los que tenemos que juntar las piezas de código para crear sistemas que funcionen, y GPT solo está produciendo piezas de código. Pero me pregunto cómo cambiará esto la forma en que trabajan los desarrolladores de software. Definitivamente ya está cambiando el juego.

También uso ChatGPT para buscar cosas en línea de la misma forma en que solía usar Google, y lo uso para indicaciones, perspectivas e información general sobre cosas sobre las que estoy escribiendo o pensando. No bromeo cuando digo que lo uso para todo, como cuando mencioné al filósofo tecnológico de la década de 1960, Marshall McLuhan, por supuesto, le pedí a ChatGPT información sobre Marshall McLuhan, y fue ChatGPT quien me dijo que 1964 fue el año en que publicó el libro que decía “el medio es el mensaje”.

El hecho de que muchos de nosotros ya hayamos pasado de Google a GPT para búsquedas básicas en Internet dice mucho. Es muy fácil comenzar a permitir que estos nuevos tipos de herramientas entren lenta e imperceptiblemente en nuestras vidas, incluso cuando nos preocupamos por las implicaciones y motivaciones detrás de ellos.

Al igual que la tecnología de software subyacente de la propia Internet, que fue creada por motivos dudosos por el ejército de los EE. UU., pero que ha provocado cambios sociales y encontrado nuevos casos de uso que estaban completamente fuera del ámbito de su propósito original, esta nueva tecnología va a encontrar su propio camino para impactar nuestras vidas. Esta nueva tecnología es real, funciona demasiado bien como para ignorarla y llegó para quedarse. Nuevamente, es por eso que estoy pasando un episodio hablando con activistas contra la guerra al respecto, porque ya es parte de nuestra realidad, y es posible que necesitemos algunos de los poderes si se ofrecen para poder hacer nuestro propio trabajo aquí en la tierra.

Dediquemos un minuto a reflexionar sobre los muchos aspectos de la vida en este planeta que no tienen los terribles problemas de los que somos tan conscientes los activistas contra la guerra. Artes, música, literatura, biología, química, física, geología, astronomía, medicina, salud, manufactura, agricultura, nutrición. En todos estos mundos, todos estos esfuerzos... el lanzamiento público de un chatbot de conocimiento general de gran capacidad está teniendo un gran impacto. No hay campo que no toque.

En el plano de la coexistencia humana pacífica, un plano en el que desearía poder pasar más tiempo existiendo en mí mismo, la inteligencia artificial es un avance milagroso de la capacidad humana que promete grandes beneficios. Si tan solo viviéramos en un mundo pacífico, seguro y equitativo, podríamos disfrutar mejor juntos de las maravillas que puede producir la inteligencia artificial.

Vemos algunas de estas maravillas cuando trabajamos con un generador de imágenes y creamos imágenes sorprendentemente inteligentes o creativas basadas en nuestras propias indicaciones que no podríamos producir de otra manera. También sentimos la paradoja de si las herramientas de inteligencia artificial se pueden usar para bien o no. Como aficionado a la tecnología, creo que no es la innovación tecnológica el problema en el planeta Tierra en el siglo XXI. Siempre agradezco la innovación tecnológica, y creo que los peligros que presenta la IA se deben al capitalismo arraigado y la guerra, al hecho de que este es un planeta en guerra consigo mismo, un planeta dominado por un 21% rico que no puede resistir ponerse en el camino suicida de construir sociedades fortaleza militarizadas que reprimen a otros seres humanos para mantener privilegios. Lo que tenemos que hacer es sanar a nuestra sociedad; lo que no tenemos que hacer es huir de los avances tecnológicos porque malinterpretamos las causas de nuestra agonía y nuestra trayectoria suicida.

Eso es lo que pienso. Por supuesto que no es lo que piensa todo activista contra la guerra, y eso está bien. Tuvimos algunas reacciones interesantes en el World Beyond War lista de discusión por correo electrónico – que es un foro animado e inteligente al que recomiendo que cualquiera se una, simplemente haga clic en el enlace de nuestro sitio web o busque world beyond war lista de discusión: después de que alguien compartiera algunas imágenes contra la guerra realmente imaginativas que se habían generado con DALL-E, y alguien más compartiera algunas palabras sorprendentemente útiles sobre cómo nuestro planeta enfermo puede encontrar caminos hacia la paz mundial.

Creo que los activistas deben dominar todas las tecnologías disponibles, que el activismo no debe ponerse en la posición de ser menos capaz de usar tecnologías innovadoras avanzadas que los gobiernos corruptos y las corporaciones codiciosas que tienen el hábito de oprimirnos.

También creo que podemos obtener verdades filosóficas sorprendentes sobre la conciencia humana y la existencia humana mediante el estudio de los algoritmos y patrones de diseño utilizados para modelarlo y simularlo. Solo pasar unos minutos jugando con ChatGPT en el sitio web de OpenAI puede revelar algunas verdades salvajes sobre la naturaleza humana.

Aquí hay una cosa salvaje en la que todavía estoy envolviendo mi cerebro. ChatGPT a veces miente. Inventa cosas. Por lo general, no verá esto cuando comience a cuestionar GPT, ya que generalmente obtendrá una respuesta poderosa a la primera pregunta en un hilo de conversación. Luego, GPT se mantiene al día con usted mientras hace preguntas de seguimiento, y aquí es donde es posible retroceder GPT a una esquina donde comienza a mentir directamente. Una de las primeras preguntas que le hice a ChatGPT fue que me hablara de los mejores podcasts contra la guerra porque, naturalmente, mi ego estaba comprometido y quería ver si el World Beyond War el podcast aparecería en la lista.

Ahora, dado que GPT está preentrenado, es decir, fue preentrenado y ya no se alimenta activamente con noticias e información actualizadas, por lo que no esperaría que sepa mucho sobre mi pequeño podcast. Tampoco quería sesgar los resultados mostrándole a GPT que estaba interesado en un podcast en particular, así que le pregunté si había algún podcast excelente contra la guerra y me aseguró que efectivamente los había. Luego comencé a entrar en detalles, con la esperanza de incitarlo a nombrar el World Beyond War podcast preguntando: ¿puede hablarme de podcasts que hayan entrevistado a activistas conocidas como Medea Benjamin? Aquí es donde las cosas comienzan a ponerse divertidas. Una vez que el sistema hace un reclamo, intentará respaldar el reclamo, así que después de asegurarme que efectivamente había podcasts que habían entrevistado a Medea Benjamin, le pedí que nombrara uno de estos podcasts, y luego me dijo que Medea Benjamin estaba la presentadora de su propio podcast. ¡Eh, ella no lo es! Si lo fuera, sin duda lo escucharía. Pude hacer que ChatGPT mintiera al retroceder en una esquina donde necesitaba proporcionar información que no tenía, por lo que inventó información que sonaba realista.

Esto sucede más a menudo de lo que uno pensaría. También puede atrapar fácilmente a ChatGPT en un error al arrojarle información verdadera pero contradictoria. Después de que GPT me informara correctamente que Marshall McLuhan introdujo la cita "El medio es el mensaje" en 1964, recordé que este filósofo brillante y agudo también había escrito una especie de seguimiento irónico de su libro anterior que abordaba los aspectos más oscuros y problemáticos. las formas en que los medios pueden hacer que las mentes humanas se duerman, las aterradoras poblaciones del control masivo de la población corporativa a través de los medios, porque Marshall McLuhan realmente era tan asombroso, entendió este peligro allá por la década de 1960 y publicó otro libro en 1967 con el artista Quentin Fiore. llamado “El Medio es el Masaje”.

Así que aquí es donde las cosas se pusieron raras con GPT. Le pedí a ChatGPT que me hablara sobre la cita de Marshall McLuhan "el medio es el masaje"... y GPT me informó rotundamente que McLuhan no había dicho "el medio es el masaje" sino que había dicho "el medio es el mensaje". Claramente, GPT pensó que el masaje era un error tipográfico. Luego informé a GPT que era incorrecto y que McLuhan había dicho tanto "el medio es el mensaje" como "el medio es el masaje". Tan pronto como dije esto, ChatGPT se dio cuenta de su error y se disculpó y me informó que sí, "el medio es el masaje" era un libro que había escrito en 1967.

Entonces, ¿por qué se equivocó primero, y especialmente por qué se equivocó cuando ya tenía acceso a la respuesta correcta a su alcance? Bueno, aquí es donde GPT está comenzando a revelar verdades sorprendentes sobre nosotros mismos, porque de hecho los dos errores o malas conductas de GPT lo hicieron parecer más humano, no menos. Recuerda que G en GPT significa generativo. El sistema está diseñado para generar respuestas cuando no está seguro de la respuesta correcta. Puede que le diga el título de una película o un libro que no existe, pero será un título que parece que podría existir. Si tiene una conversación larga y abierta con ChatGPT sobre cualquier tema del que sabe mucho, verá rápidamente que comienza a cometer errores.

La forma en que pude arrinconar a GPT haciéndole preguntas de seguimiento a sus propias respuestas, lo que eventualmente provocó que generara información aparentemente realista pero falsa en un intento de respaldar sus declaraciones anteriores no me pareció inhumano, pero sí completamente humano.

Vemos aquí el poder contundente de los estilos de argumentación retóricos y manipuladores. Tal vez lo que podemos aprender de este sorprendente mal comportamiento de ChatGPT es que es humanamente imposible aprehender la verdad sin fabricar verdades de una forma u otra, y si no tenemos cuidado, estas verdades inventadas que usamos con fines retóricos pueden convertirse en mentiras que somos. obligados a defender con más fabricaciones. Chico, esto seguro me parece real.

Aún más realista: sabemos que el comportamiento humano de ChatGPT incluye mentir. ¡Y sin embargo confiamos en ello! Incluso sigo usándolo yo mismo, porque, en realidad, tengo la suficiente confianza en mí mismo como para creer que siempre podré detectar cuándo GPT se esfuerza por obtener una respuesta y genera información falsa. Oye, tal vez me estoy engañando a mí mismo, y tal vez debería pensar en mi propia propensión a creer verdades inventadas y mi propia propensión a permitir que otros mientan.

Aquí hay una forma en que GPT nos hace más inteligentes, al señalar las formas en que nos involucramos con la mentira, las fachadas, las mentiras piadosas y los engaños amistosos en nuestras relaciones humanas normales. En pocas palabras: ChatGPT no puede simular el comportamiento humano sin mentir a veces. Esto es una gran cosa para que todos nosotros pensemos.

Aquí hay algo más en lo que pensar: ¿cómo nos va a los humanos en términos de mantenernos al día con las innovaciones tecnológicas que definen a nuestras sociedades? En los últimos años, nos estamos adaptando a los avances en IA al mismo tiempo que estamos absorbiendo la invención de blockchain, un nuevo método tecnológico para construir bases de datos compartidas con nuevos conceptos de propiedad, acceso y validación. Hicimos un episodio anterior sobre blockchain, y personalmente estoy bastante seguro de que la mayoría de las personas que conozco todavía no entienden las formas en que blockchain está cambiando nuestras vidas y cambiará nuestras vidas en el futuro, y ahora tenemos un lenguaje extenso. ¡modelos y motores de conocimiento general para cambiar nuestras vidas y también nuestro futuro! Ponga esto encima de, hmm... ¿adónde voy aquí?... el proyecto del genoma humano, los grandes avances en la ciencia del cerebro, la exploración y colonización del espacio... oye, compañeros humanos, ¿nos mantenemos al día con todo esto?

Ahora agreguemos las disputas tecnológicas y científicas sobre pandemias como COVID, y no nos detengamos allí, sino que pasemos a considerar la situación de las armas nucleares ampliamente disponibles en manos de los llamados gobiernos corruptos e incompetentes dirigidos por burócratas envejecidos, y la política. de destrucción mutua asegurada.

¿Nos mantenemos al día con esto? No, pero esta mierda nos sigue el ritmo y tiene nuestro número. Cada mañana me despierto y leo sobre la guerra de poder entre la OTAN y Rusia que ha estado asesinando trágicamente a los pobres seres humanos que viven en Ucrania. Y cada mañana me pregunto si este es el día en que la incompetencia de nuestros supuestos líderes provocará que comience la guerra nuclear; cada día me pregunto si este es el último día para la vida humana en el planeta tierra.

Es el caluroso verano de 2023. Hay una nueva película llamada "Oppenheimer" sobre el científico cuyo trabajo condujo al increíble horror del asesinato instantáneo de cientos de miles de seres humanos en Hiroshima y Nagasaki Japón en 1945. No creo cualquiera de nosotros hemos logrado expandir nuestras propias mentes lo suficiente como para comprender el mal absoluto, las verdades impactantes e insoportables de los errores que han cometido nuestras sociedades, y de nuestra incapacidad para mejorarnos a nosotros mismos y salir de nuestra patética y vergonzosa adicción social a Odio masivo y violencia masiva.

Mencioné anteriormente que algunas personas preguntan si la inteligencia artificial puede conducir o no a la conciencia y / o la sensibilidad, si un sistema de IA puede desarrollar emociones y sentimientos, y qué significan estas palabras y estas preguntas. Todavía no he visto la película Oppenheimer y me asquea bastante la idea de una película sobre asesinatos en masa en Japón que no muestre los rostros de las víctimas japonesas. En lugar de preguntarme si los sistemas de IA son sensibles o no, todo lo que quiero decir es que cada persona incinerada en Hiroshima y Nagasaki era sensible y consciente. Esa es una verdad que no creo que hayamos logrado enfrentar todavía. Tal vez necesitemos entrenar nuestras propias mentes en esto un poco más.

Y ahí es donde terminamos hoy. Los humanos no podemos manejar la verdad sobre los problemas que hemos creado y los cambios que necesitamos hacer para mejorarnos a nosotros mismos. Los bots tampoco pueden manejar la verdad. Gracias por compartir este espacio conmigo mientras reflexiono sobre los misterios y las ironías de la existencia humana, y nos sacaré con la voz humana de una cantante y compositora que he amado durante mucho tiempo, Sinead O'Connor, y una canción llamada Healing Room. Gracias por escuchar el episodio 50. Nos vemos pronto para el 51.

World BEYOND War Podcast en iTunes

World BEYOND War Podcast en Spotify

World BEYOND War Podcast en Stitcher

World BEYOND War Podcast RSS Feed