Марк Еліот Стайн, World BEYOND War, 31 липня 2023 року

Це повна розшифровка 50 серії World BEYOND War: новий подкаст.

Зараз липень, спекотне літо 2023 року. Ви знаєте, хто я, я Марк Еліот Стайн, директор з технологій World Beyond War, все ще тут, на землях Ланапе в Брукліні, Нью-Йорк, і все ще чинить правильно тут, на World Beyond War Подкаст, За винятком того, що сьогодні особливий, тому що це епізод 50, вау, кругле число.

Коли я починав цей подкаст, я, мабуть, навіть не думав про те, чи вийду я коли-небудь до 50 епізодів. Число 50 точно не здавалося б реалістичним у той час. Гадаю, я головним чином думав, чи зможу я коли-небудь закінчити епізод номер 1, і перед тим, як я це зробив, було кілька близьких дзвінків, щоб відмовитися.

І ось мені 50, і як це радісно усвідомлювати, що ми з’ясували, як зробити так, щоб цей антивоєнний подкаст справді працював, і знайшли аудиторію, яка зростає щомісяця. Я дуже пишаюся цим подкастом і вдячний усім, хто до цього часу брав участь у ньому.

Подкастинг – унікальний творчий формат. Це не схоже ні на що інше. Я знаю це, тому що я сам залежний від подкастів. У мене є принаймні 20 регулярних шоу, які мене дуже цікавлять – про історію, політику, технології, музику, літературу, телебачення, кіно. Коли я в настрої розслабитися та розширити свої знання водночас, насправді немає іншого формату, який вражає так, як подкаст. Я вважаю, що це важлива відмінність: залучіть ведучого та гостя до вебінару, скажімо, або до чату, що транслюватиметься в прямому ефірі, і вони матимуть один тип розмови, але якщо ви залучите тих самих двох людей до подкаст-інтерв’ю, якимось чином вони Будете вести інший тип розмови – ймовірно, більш особисту, більш спонтанну, більш безладну, більше в даний момент, менш спрямовану на досягнення висновку.

Чому це саме так? Я не знаю, але покійний філософ медіа та технологій Маршалл Маклюен у 1964 році написав щось про те, як швидко нова популярність телебачення змінює сучасне суспільство, і він мав рацію. За словами Маклюена, середовищем є повідомлення. Формат – це зміст.

Наприклад, ви можете написати ті самі слова у Facebook, Twitter і LinkedIn, і в кожному випадку слова матимуть різне значення. Оскільки подкасти прославляють спонтанний і невідрепетирований людський голос, подкастинг став форумом, де людську амбівалентність або навіть незрозумілу суперечність та іронію можна легко прийняти та зрозуміти. Я вважаю, що це хороший форум, щоб поговорити про тенденцію, про яку дуже багато в новинах, і я маю багато власних амбівалентних і незрозумілих думок, щоб поділитися з вами сьогодні. Я говорю про штучний інтелект.

Коли в 1964 році Маршалл Маклюен сказав, що медіа — це повідомлення, тоді мало хто думав про те, як телебачення та інші інтимні домашні ЗМІ змінюють саму структуру людського суспільства. Сьогодні нове середовище, створене завдяки найсучаснішим технологіям, також загрожує величезним суспільним впливом. Я говорю про такі популярні інструменти штучного інтелекту загального призначення, як-от ChatGPT, які доступні кожному, хто має підключення до Інтернету. Якщо ви ще не чули про ChatGPT, він привертає багато уваги через те, наскільки добре він емулює людську розмову. і як легко він може інтегрувати та отримати весь широкий спектр доступних загальних знань.

Чат-боти існують уже кілька років – вони можуть бути такими ж простими та нешкідливими, як дружні автоматизовані чат-боти для обслуговування клієнтів на веб-сайтах BestBuy або Ticketmaster. Нові чат-боти, такі як ChatGPT4, не обмежуються електронними продуктами чи квитками на концерти – це дуже різні типи механізмів знань, відомих як великі мовні моделі, навчені охоплювати весь людський інтелект.

Іноді люди думають, що буква G у ChatGPT означає генерал, і це було б гідним припущенням, оскільки система створена для демонстрації загального інтелекту та загальних знань. G фактично означає Generative, що означає, що цей продукт також призначений для створення речей – для створення оригінальних зображень і слів. P означає pre-trained, про що ми поговоримо за кілька хвилин, а T означає Transformer, який не є класичним альбомом Лу Ріда, а шаблоном розробки програмного забезпечення, що дозволяє мовній моделі реагувати на введені тексти не обробка одного слова за раз, але розглядаючи та запускаючи перетворення всього введеного тексту в цілому.

Ці нові чат-боти можуть спілкуватися на будь-яку тему в дружньому, міжособистісному стилі розмови з нюансами. Чат-боти можуть писати есе, вирішувати проблеми, здійснювати глибокий пошук у базі даних, генерувати комп’ютерний код, миттєво відповідати на складні запитання. ChatGPT та інші подібні пропозиції демонструють рівень лінгвістичної та комплексної гнучкості, який, здається, просуває сферу штучного інтелекту вперед швидше, ніж багато хто з нас очікував. Нещодавно з’явилася новина про те, що деякі співробітники Google вірять, що їх власна система штучного інтелекту може пройти тест Тюрінга та стати невідрізною від розумного людського спілкування, налякавши власних експертів Google своїми доказами свідомості. Я не знаю, чи особисто я вірю, що будь-який штучний інтелект може пройти тест Тюрінга, але я знаю, що зараз багато експертів вважають, що це стає можливим.

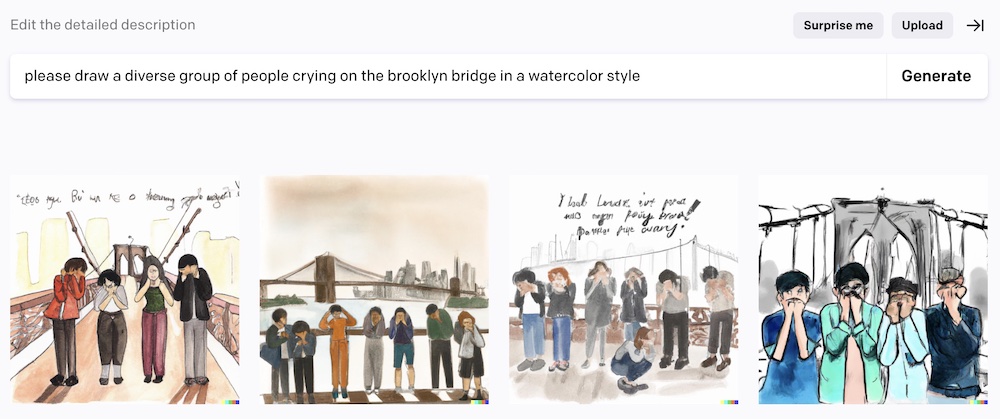

Чат-боти загального знання – далеко не єдиний популярний варіант використання ШІ. Генератори зображень можуть миттєво створювати візуальні твори мистецтва з текстових підказок – іноді вражаючі, розумні зображення, на створення яких у фізичних художників чи цифрових художників знадобляться години, дні чи тижні. Створення зображень із текстових підказок сьогодні стало реальністю за допомогою безкоштовних онлайн-генераторів зображень зі штучним інтелектом, таких як DALL-E, від OpenAI, тієї самої компанії з Силіконової долини, яка створила ChatGPT. Ви можете уявити ідею та описати стиль малювання, і цей веб-сервіс чарівним чином надсилає вам купу різних варіантів спроб втілити вашу ідею.

Сьогодні це реальність, і сьогодні також є реальністю те, що ChatGPT4 може писати досвідчені, вдумливі, розлогі есе майже на будь-яку тему, про яку їх запитують, – есе, які можуть бути достатньо хорошими, щоб отримати диплом про вищу освіту.

Можливо, ще занадто рано робити такі прогнози, але здається, що інтелектуальні чат-боти та генератори зображень – машинне письмо та машинне мистецтво – є головною технологічною інновацією та головною суспільною інновацією, яка вплине на всіх нас на землі одним чином. або інший. Хто знає, куди йде майбутнє сьогодні, але здається принаймні можливим, що запуск ChatGPT3 у 2022 році колись запам’ятають визначним моментом в культурній історії, подібним до запуску браузера Mosaic у 1993 році, який поклав початок усьому популярному Інтернет-бум, у якому ми живемо й сьогодні.

Також здається можливим, я стурбований сказати, що це нове нововведення спричинить нові серйозні проблеми, з якими нам усім доведеться мати справу, навіть якщо багато хто з нас може відчувати, що наше суспільство вже потопає в небажаних наслідках інші технологічні інновації, яких ми не вимагали в нашому житті, не запрошували в наше життя, але які все одно є в нашому житті.

Я хочу присвятити цей епізод розмові про те, як ШІ впливає на нас як на антивоєнних активістів. Дозвольте сказати це наперед: штучний інтелект є гарячою темою, дуже суперечливою, і так воно і повинно бути. Нам слід про це хвилюватися і говорити, і, на мою думку, ми також повинні відкрити свій розум для того, що ця технологія може зробити.

Це суперечливо серед прогресивних людей і активістів, і це суперечливо для всіх. Це має бути суперечливим, і я не беру цей епізод, тому що маю прості відповіді про те, як ці нещодавні інновації можуть вплинути на нашу планету. Я знаю, що вони вплинуть на наш світ, і я знаю, що антивоєнні активісти повинні говорити про це. Тож я роблю цей епізод, щоб розпочати розмову, викласти різні проблеми, з якими, на мою думку, напевно стикаються багато антивоєнних активістів, коли вони говорять на цю тему, і, можливо, щоб висловити певне розуміння всіх сторін цієї заплутаної ситуації. питань. Це те, що я збираюся зробити тут – і коли ви закінчите слухати цей епізод, будь ласка, поділіться своїми відгуками на нашому world beyond war веб-сторінку для цього епізоду або зв’язавшись зі мною напряму – мене легко знайти.

З точки зору впливу на повсякденне життя, багато хто задається питанням, чи не позбавить багатьох людей роботи дивовижні можливості штучного інтелекту. Це часто перше, що хвилює людей, коли вони бачать силу ШІ. Чи ці передові можливості призведуть до того, що різні сектори повноцінної зайнятості людей і спроби стануть раптово небажаними? Наше суспільство вже сильно розбалансовано з точки зору того, хто працює, хто заробляє, а хто витрачає. Якщо екосистеми середнього класу, які працюють заради життя, будуть ще більше порушені, оскільки штучний інтелект може виконувати багато тих самих завдань краще та безкоштовно, ми можемо бути впевнені, що порушення збільшить розрив між заможними та іншими, що 1 % зможе отримати вигоду від змін, тоді як нам залишиться зіштовхнутися з наслідками, і що 1% також зробить інструменти штучного інтелекту, які допомагають 1%, недоступними для людей, яким може знадобитися їхня допомога, або занадто дорогими для доступ до них.

Давайте подивимося правді в очі, у хижацькій капіталістичній економіці, в якій багато з нас живуть, безробіття означає втягування в борги та втрату свободи вибору, і це саме те, що ці соціопатичні економіки-фортеці покликані робити зі звичайними людьми – забирати нашу владу вибору і змушують нас платити їм і працювати на них. Це майбутнє бачення фортечного капіталізму сьогодні: ми матимемо нові інтелектуальні та потужні комп’ютери, оскільки ми самі злиденні.

Крім того, поліція та військові вже почали використовувати інструменти штучного інтелекту разом із новими потужними та жорстокими роботами. Я вважаю, що це може бути найсерйознішою та безпосередньою загрозою, яку зараз представляє ШІ, і я вважаю, що протестні рухи, які облягає поліція, як, скажімо, важливий рух «Стоп поліцейським» в Атланті, штат Джорджія, вже мають справу з цією зміненою реальністю. Системи ШІ несуть упередження та закодовані цінності своїх творців-людей, тому навчена ШІ поліція чи військові загрожують стати буквальними машинами для полювання та вбивства вразливих груп населення, обираючи свої цілі на основі зовнішності чи раси. У світі, який вже вирує з-під контролю через війну від України до Ємену, ідея розширення можливостей однієї чи іншої сторони – і, неминуче, обох сторін – новими видами машин для вбивств і режимів придушення, закодованих злісним расовим профілюванням, є такою ж жахливою, як це звучить.

Найгірші сценарії масового безробіття або расово кодованого штучного інтелекту, який використовується поліцією та військовими силами, жахають, і ми не можемо спати на цьому, оскільки наслідки вже є в нашому світі. Це вже відбувається. Отже, давайте просто почнемо цю розмову з визнання того, що два окремі жахи, які, здається, представляє передовий штучний інтелект – масове безробіття та зловживання з боку поліції та військових – є двома різними способами, якими могутні сили вкоріненого багатства та привілеїв викрадають права та свободи людей. .

Говорячи про вкорінене багатство та привілеї – давайте поговоримо про OpenAI, компанію в Північній Каліфорнії, яку ви можете знайти в Інтернеті за адресою OpenAI.com. Ця компанія була маловідома, поки вони не запустили генератор зображень DALL-E у 2021 році, а потім у листопаді 2022 року, лише дев’ять місяців тому, вони випустили свій перший загальнодоступний чат-бот ChatGPT3, за яким швидко пішли потужніші та потужніші ChatGPT3.5 та ChatGPT4. , доступні версії.

Я був дуже збитий, коли вперше побачив зображення, які може створювати DALL-E, і був збитий ще більше, коли вперше спробував ChatGPT. Завдання, яке намагалися вирішити ці інструменти, було мені добре знайоме, оскільки я сам інтенсивно вивчав ШІ, як і багато розробників програмного забезпечення. Моя перша зустріч зі штучним інтелектом була незалежним навчальним проектом, яким я займався в коледжі кілька десятиліть тому.

Це були 1980-ті роки, і, можливо, деякі дуже молоді люди будуть здивовані, дізнавшись, що такі люди, як я, займалися штучним інтелектом у 1980-х роках, але термін штучний інтелект майже такий же старий, як сама комп’ютерна революція. Навіть незважаючи на те, що досягнення штучного інтелекту з 1950-х до 1990-х років були інфантильними порівняно з досягненнями, які ми спостерігали з тих пір.

Насправді ця галузь була настільки відкритою у 80-х, що я зміг отримати кілька кредитів на останньому курсі за спеціальністю «Філософія та інформатика», підготувавши оригінальний незалежний навчальний проект для програми, яка аналізувала речення англійською мовою та відповідайте таким чином, щоб продемонструвати або імітувати базове розуміння. Я кодував у LISP на неймовірно громіздкому терміналі Unimatic із зеленим сяйвом, підключеному до масивного мейнфрейму Univac розміром із велику будівлю та, ймовірно, мав меншу потужність, ніж MacBook, на якому я зараз записую цей подкаст, тому що саме так ми працювали ще в 80-ті роки.

Захоплююче завдання мого проекту незалежного вивчення штучного інтелекту полягало в тому, щоб розібрати речення, які містять прості дієслова та іменники, і відповісти на них. Наприклад, я вводив би речення на зразок «у мене є кіт на ім’я Хеппі», «мій кіт помаранчевий» і «всі коти говорять нявкання» у свою програму LISP, яка демонструвала б певне розуміння, відповідаючи на запитання на кшталт «Чи Хепі помаранчевий?» або «Чи каже кіт Марка нявкання?». Досить кумедно, але я намагався створити чат-бота зі штучним інтелектом прямо на своєму мейнфреймі Univac.

Б'юсь об заклад, що багато інших студентів намагалися зробити те саме в той час, але ніхто з нас не зайшов дуже далеко, тому що це були 1980-ті роки, і одна ключова геніальна ідея ще не дійшла до нас: нейронна мережа, яка забезпечує програмне забезпечення структура, розроблена для виконання масивних паралельних простих операцій, подібних до нейронів у людському мозку. Хоча моя програма LISP забезпечувала однопотокові обчислення, а програми Fortran, COBOL і Pascal дотримувалися тієї ж обмеженої однопотокової парадигми, нейронні мережі забезпечували паралельні елементарні потоки, які виконували прості обчислення паралельно. Людський мозок виконує багато паралельних обробок — одночасні каскадні операції створюють ілюзію сингулярності — і структура програмного забезпечення, відома як нейронна мережа, дозволить програмістам отримати переваги цієї паралельної обробки — після того, як я закінчив коледж.

Разом із концепцією нейронної мережі з часом з’явилася концепція навчання нейронної мережі за допомогою повторюваних дій – ще одна концепція, яка ще не дійшла до нас у 80-х. Я надавав своїй програмі LISP невелику кількість повних речень і не давав їй жодного зворотного зв’язку, за допомогою якого можна було б виправити та покращити її продуктивність. Замість того, щоб вводити речення в комп’ютерний термінал, я повинен був завантажувати в нього цілі книги, газети та енциклопедії та постійно взаємодіяти з ним, щоб забезпечити зворотний зв’язок щодо його поведінки, оскільки моя програма неодноразово намагалася симулювати найпростіші, примітивні дії розуміння. Давши йому багато матеріалу для читання, щоб створити багату та складну базу знань, і регулярно й ретельно навчаючи його, я міг би змусити свою комп’ютерну програму сказати щось дивовижне про те, чи був у мене помаранчевий кіт чи ні. Виявилося, що нейронні мережі та повторюване навчання допомогли прокласти шлях до успішного моделювання людського інтелекту, яке ми бачимо сьогодні за допомогою чат-ботів.

Ви помітили, що я говорю про моделювання людського інтелекту. Це вказує на іншу суперечку. Деякі люди вважають термін «штучний інтелект» смішним. Що гірше, ніж смішно, дехто вважає цю ідею етично тривожною, тому що, якщо інтелект породжує свідомість, штучний інтелект може перетворитися на штучну свідомість – штучне відчуття, штучну свавілля, штучне право на існування. Безумовно, це викликає багато екзистенційних питань. Усі ці запитання актуальні та важливі. Дехто задається питанням, чи не розвивають свідомість системи знань ШІ та мовні моделі. Особисто я вважаю, що досить легко заявити, що ні, нам не потрібно турбуватися про те, що чат-боти розвиватимуть справжні почуття. Існує багато різних аспектів штучного інтелекту, про які варто хвилюватися, і це не те, про що я особисто хвилююся. Але це не означає, що я можу довести, що я правий і що це нікого не повинно хвилювати. Можливо, я просто настільки перевантажений різними речами, про які маю хвилюватися, що в мене немає часу хвилюватися про це. Я не маю остаточної відповіді на всі запитання, які можуть виникнути щодо питань машинного сприйняття, і я не збираюся прикидатися, що маю. Але я знаю, з якими питаннями нам потрібно з’ясувати, як протистояти.

Одна думка, яку я іноді чую в спільнотах активістів, полягає в тому, що штучний інтелект – це купа галасу – ілюзія, породжена чудовими розмовними навичками великої мовної моделі. Звичайно, GPT може проаналізувати запитання та відповісти елегантною фразеологією, але чому це щастя з мовою змушує нас уявити, що було зроблено якийсь значний прогрес? Google і Wikipedia вже зробили всі людські знання легко доступними безкоштовно в Інтернеті, на розчарування Британської енциклопедії. Ми чуємо весь цей ажіотаж про ChatGPT просто тому, що він представляє лінгвістичний фасад людської свідомості, ілюзію, в яку ми всі так охоче впадаємо. Я думаю, що тут є певна достовірність. Можливо, якби Google або Wikipedia спочатку були запущені таким несподіваним і повністю сформованим способом, як це зробив ChatGPT, можливо, ми б говорили про запуск Google або Wikipedia як про величезний прогрес у колективному людському розумі, тому що обидва вони вже вплинули на наш світ.

Проте, як я вже згадував вище, коли говорив про нейронні мережі та навчання, описувати великі мовні моделі як фасади означає недооцінювати рівні структури програмного забезпечення, які повинні існувати, щоб зробити це лінгвістичне щастя можливим.

На мій погляд, важливе питання: давайте подивимося на етику OpenAI та її керівників, засновників, інвесторів і партнерів. Тут ціла купа проблем.

OpenAI.com — це приватно фінансована дослідницька лабораторія, що виникла в тій самій надзаможній і розповсюдженій екосистемі технологічних інкубаторів Кремнієвої долини, яка дала нам Facebook, Google, Microsoft, Amazon і Oracle. Його засновники включають Ілона Маска, знаменитого мільярдера, чиї соціопатичні публічні зауваження справді нудить мене так само, як і багатьох інших людей. Ілон Маск ніколи не брав безпосередньої участі в OpenAI, і він перейшов до інших речей, наприклад, демонстрації своєї образливої особистості в соціальних мережах, тож це все, що я хочу сказати про Ілона Маска сьогодні.

На мій погляд, ще більшим прокляттям є те, що OpenAI тісно пов’язана з Microsoft, головним спекулянтом на війні та головним спекулянтом у сфері штучного інтелекту для війни. Цей тривожний зв’язок, я сподіваюся, хвилюватиме людей навіть більше, ніж зв’язок з Ілоном Маском. Ми маємо бути дуже стурбовані тим, що дружнє обличчя DALL-E та OpenAI є корисним фасадом для принаймні одного надзвичайно впливового та злого спекулянта війни, Microsoft, яка вже розробляє види військових та поліцейських програм штучного інтелекту з расовим кодуванням, про які ми говорили. приблизно вище. Це вже відбувається за лаштунками Microsoft та інших технологічних гігантів США, які глибоко пов’язані з військовою машиною США. І це найгірша новина, яку я можу придумати.

Ми в антивоєнному русі не можемо відвернутися від штучного інтелекту через його злий потенціал. Звичайно, я не маю на увазі, що кожен у антивоєнному русі повинен дозволити технологічним зазіханням у своє власне життя. Я радий, що багато прогресивних людей і активістів роблять правильний вибір, щоб уникнути модних технологічних інновацій у своєму житті. Я можу поважати таке ставлення, хоча я сам далекий від способу життя без технологій. Технології — це моя галузь, моя кар’єра, і як технолог я зачарований генієм, креативністю та інноваціями, що лежать в основі таких починань, як штучний інтелект.

Крім того, просто як допитлива людина, я абсолютно зацікавлений у тому, щоб отримати уявлення про людський інтелект, дізнавшись про те, як комп’ютери були створені для його моделювання. Я також дозволяю ChatGPT у своє життя, тому що я виявив, наскільки він корисний. Я заходжу на OpenAI.com і постійно задаю йому запитання. Я використовую ChatGPT для написання коду, включаючи Javascript для нової версії нашої інтерактивної карти іноземних військових баз США, над якою я працюю цього літа разом з іншими людьми з World Beyond War.

Скажімо, я хочу очистити параметр рядка запиту, видаливши спеціальні символи з регулярним виразом, про що я б скористався, щоб запитати Stack Overflow, і я б зібрав свій робочий код із рекомендованих фрагментів, опублікованих у потоці розмови . Натомість я тепер повідомляю ChatGPT, що я хочу, і ChatGPT просто видає ідеально відформатований Javascript, виконуваний файл без помилок. Більшість моїх друзів-розробників програмного забезпечення зараз використовують ChatGPT для написання коду – я знаю, що ми це робимо, тому що нам подобається про це говорити. Я не думаю, що хтось із нас, програмістів, ще не хвилюється, що ChatGPT замінить нас, тому що ми є тими, хто має поєднувати фрагменти коду, щоб створити робочі системи, а GPT лише створює фрагменти коду. Але мені цікаво, як це змінить спосіб роботи розробників програмного забезпечення. Безперечно, це вже змінює гру.

Я також використовую ChatGPT, щоб шукати інформацію в Інтернеті так, як я використовував би Google, і я використовую його для підказок і перспектив і довідкової інформації про речі, про які я пишу або думаю. Я не жартую, коли кажу, що використовую його для всього. Наприклад, коли я згадав вище про філософа технологій 1960-х років Маршалла Маклюена, звичайно, я попросив у ChatGPT трохи інформації про Маршалла Маклюена, і саме ChatGPT сказав мені, що 1964 рік був роком, коли він опублікував книгу, в якій говориться: «Медіум — це повідомлення».

Той факт, що так багато з нас уже перейшли з Google на GPT для базового пошуку в Інтернеті, говорить багато про що. Дуже легко дозволити цим новим різновидам інструментів повільно й непомітно входити в наше життя, навіть коли ми хвилюємося про наслідки та мотивацію, що стоять за ними.

Подібно до базової технології програмного забезпечення Інтернету, яка була створена з сумнівних причин американськими військовими, але згодом спричинила суспільні зміни та знайшла нові випадки використання, які повністю виходили за межі її початкової мети, ця нова технологія збирається знайти власний шлях до впливу на наше життя. Ця нова технологія реальна, вона працює надто добре, щоб її ігнорувати, і вона тут, щоб залишитися. Знову ж таки, саме тому я приділяю епізод розмові про це з антивоєнними активістами – тому що це вже є частиною нашої реальності, і нам можуть знадобитися деякі повноваження, якщо нам запропонують, щоб виконати нашу власну роботу тут, на землі.

Давайте витратимо хвилину на роздуми про багато аспектів життя на цій планеті, які не мають жахливих проблем, про які ми, антивоєнні активісти, так знаємо. Мистецтво, музика, література, біологія, хімія, фізика, геологія, астрономія, медицина, здоров’я, виробництво, сільське господарство, харчування. У всіх цих світах, у всіх цих починаннях... публічний запуск високопродуктивного чат-бота для загальних знань має великий вплив. Немає поля, якого б воно не торкалося.

На площині мирного людського співіснування – площині, на якій я хотів би приділяти більше часу самому собі – штучний інтелект є дивовижним прогресом людських можливостей, який обіцяє великі переваги. Якби ми жили в мирному, безпечному та справедливому світі, ми могли б краще разом насолоджуватися чудесами, які може творити штучний інтелект.

Ми бачимо деякі з цих чудес, коли працюємо з генератором зображень і створюємо приголомшливо розумні або креативні зображення на основі наших власних підказок, які ми б не змогли створити інакше. Ми також відчуваємо парадокс щодо того, чи можна інструменти штучного інтелекту використовувати на благо. Як технар, я вважаю, що проблема планети Земля у 21 столітті не в технологічних інноваціях. Я завжди вітаю технологічні інновації, і я вважаю, що небезпека штучного інтелекту пов’язана з укоріненим капіталізмом і війною – через те, що це планета, яка воює сама з собою, планета, на якій домінує 1% заможних, які не можуть встояти перед тим, щоб поставити себе нанівець. самогубний шлях побудови мілітаризованих суспільств-фортець, які пригнічують інших людей заради збереження привілеїв. Що нам потрібно зробити, це зцілити наше суспільство; чого нам не потрібно робити, це тікати від технологічного прогресу, тому що ми неправильно розуміємо причини нашої агонії та нашої суїцидальної траєкторії.

Ось що я думаю. Звичайно, це не те, що думає кожен антивоєнний активіст, і це нормально. У нас були цікаві реакції на World Beyond War список обговорень електронною поштою – це жвавий та інтелектуальний форум, до якого я рекомендую будь-кому приєднатися, просто натисніть посилання на нашому веб-сайті або знайдіть world beyond war список обговорень – після того, як хтось поділився справді фантастичними антивоєнними зображеннями, створеними за допомогою DALL-E, а хтось поділився напрочуд корисними словами про те, як наша хвора планета може знайти шляхи до миру у всьому світі.

Я вважаю, що активісти повинні оволодіти всіма доступними технологіями – що активізм не повинен поставити себе в положення, яке є менш здатним використовувати передові інноваційні технології, ніж корумповані уряди та жадібні корпорації, які мають звичку пригнічувати нас.

Я також вірю, що ми також можемо отримати дивовижні філософські істини про людську свідомість і людське існування, вивчаючи алгоритми та шаблони проектування, які використовуються для його моделювання та імітації. Просто витративши кілька хвилин на розмову з ChatGPT на веб-сайті OpenAI, ви можете відкрити деякі дивні істини про людську природу.

Ось одна дивна річ, над якою я все ще ламаю голову. ChatGPT іноді бреше. Це вигадує речі. Зазвичай ви не побачите цього, коли почнете допитувати GPT, тому що це зазвичай дасть потужну відповідь на перше запитання в розмові. Тоді GPT не відстає від вас, коли ви задаєте додаткові запитання, і тут можна відсортувати GPT у кут, де він починає лежати. Одним із перших запитань, яке я коли-небудь задав ChatGPT, було розповісти мені про найкращі антивоєнні подкасти, тому що, природно, моє его було задіяне, і я хотів побачити, чи World Beyond War подкаст з’явиться в списку.

Тепер, оскільки GPT пройшов попередню підготовку, тобто її попередньо навчили, і її більше не отримують актуальні новини та інформація, тому я не очікував, що вона буде знати багато про мого маленького подкаст. Я також не хотів спотворювати результати, показуючи GPT, що мене цікавить один конкретний подкаст, тому я запитав його, чи є якісь чудові антивоєнні подкасти, і він запевнив мене, що вони дійсно є. Потім я почав вникати в деталі, сподіваючись спонукати його назвати World Beyond War подкаст, запитуючи – чи можете ви розповісти мені про подкасти, в яких брали інтерв’ю у відомих активістів, таких як Медея Бенджамін. Ось де все починає ставати смішним. Щойно система висловить претензію, вона спробує підтвердити цю претензію, тож після того, як вона запевнила мене, що справді існують подкасти, які брали інтерв’ю з Медеєю Бенджамін, я попросив її назвати один із цих подкастів, і тоді вона повідомила мені, що Медея Бенджамін була ведуча власного подкасту. Гм, ні! Якби вона була, я б її, звичайно, послухав. Мені вдалося змусити ChatGPT брехати, заклавши його в куток, де йому потрібно було надати інформацію, якої він не мав, тому він створив інформацію, яка звучала реалістично.

Це трапляється частіше, ніж можна було б подумати. Ви також можете легко зловити ChatGPT на помилці, накидаючи йому правдиву, але суперечливу інформацію. Після того, як GPT правильно повідомила мені, що Маршалл Маклюен ввів цитату «Медіум — це повідомлення» в 1964 році, я згадав, що цей блискучий і гострий філософ також написав свого роду іронічне продовження своєї попередньої книги, яка зверталася до темнішого та більш тривожного. способи, за допомогою яких ЗМІ можуть приспати людські уми, страшні популяції корпоративного масового контролю над населенням за допомогою ЗМІ – оскільки Маршалл Маклюен справді був таким чудовим, він розумів цю небезпеку ще в 1960-х роках і опублікував ще одну книгу в 1967 році з художником Квентіном Фіоре під назвою «Медіум — це масаж».

Отже, ось де все стало дивним із GPT. Я попросив ChatGPT розповісти мені про цитату Маршалла Маклюена «Медіум — це масаж»… і GPT прямо повідомив мені, що Маклюен не сказав «медіум — це масаж», а радше сказав «медіум — це повідомлення». Очевидно, GPT вважав масаж помилкою. Потім я повідомив GPT, що це було неправильно і що Маклюен справді сказав, що «засіб — це повідомлення» і «засіб — це масаж». Щойно я сказав це, ChatGPT зрозумів свою помилку, вибачився та повідомив мене, що так, «засіб — це масаж» — це книга, яку він написав у 1967 році.

Тож чому він спочатку помилився, і особливо чому він помилився, коли вже мав доступ до правильної відповіді в межах своєї досяжності? Що ж, ось де GPT починає відкривати дивовижні правди про нас самих, тому що фактично дві помилки чи неправильна поведінка GPT зробили його більш людяним, а не меншим. Пам’ятайте, що G у GPT означає генератив. Система створена для генерування відповідей, коли вона не впевнена в правильній відповіді. Це може сказати вам назву фільму чи книги, яких не існує, але це буде назва, яка, здається, може існувати. Якщо у вас є відкрита, довга розмова з ChatGPT на будь-яку тему, про яку ви багато знаєте, ви швидко побачите, що в ній починаються помилки.

Те, як я зміг загнати GPT у кут, ставлячи йому додаткові запитання до його власних відповідей, зрештою змусивши його генерувати реалістичну, здавалося б, але неправдиву інформацію, намагаючись підкріпити свої попередні твердження, здавалося мені не нелюдським, а цілком досконалим. людини.

Тут ми бачимо різку силу риторичного та маніпулятивного стилів аргументації. Можливо, чому ми можемо навчитися з цієї дивовижної неправильної поведінки ChatGPT, це те, що людині неможливо зрозуміти правду, не вигадуючи істини тим чи іншим способом, і якщо ми не будемо обережні, ці вигадані істини, які ми використовуємо в риторичних цілях, можуть перетворитися на брехню, якою ми є змушений захищатися новими вигадками. Хлопчику, це справді здається мені реалістичним.

Ще більш реалістично: ми знаємо, що людська поведінка ChatGPT включає брехню. І все ж ми віримо в це! Я навіть продовжую використовувати його сам, тому що насправді я достатньо впевнений у собі, щоб вірити, що завжди зможу виявити, коли GPT намагається отримати відповідь і генерує неправдиву інформацію. Гей, можливо, я жартую, і, можливо, мені варто подумати про свою власну схильність вірити сфабрикованим правдам і про мою власну схильність дозволяти іншим брехати.

Ось як GPT робить нас розумнішими, вказуючи на те, як ми використовуємо неправду, фасади, білу брехню та дружній обман у наших звичайних людських стосунках. Коротше кажучи, ChatGPT не може симулювати людську поведінку, іноді не збрехаючи. Усім нам варто задуматися над цим.

Ось ще про що варто подумати: як ми, люди, справляємося з тим, щоб йти в ногу з технологічними інноваціями, які визначають наше суспільство? Протягом останніх кількох років ми пристосовуємося до прогресу в штучному інтелекті одночасно з винаходом блокчейну, нового технологічного методу створення спільних баз даних із новими концепціями власності, доступу та перевірки. Ми зробили попередній епізод про блокчейн, і я особисто впевнений, що більшість моїх знайомих досі не розуміють, як блокчейн змінює наше життя і змінюватиме наше життя в майбутньому – і тепер ми маємо широку мову моделі та механізми загального знання, щоб змінити наше життя та наше майбутнє! Покладіть це на вершину, хм… куди мені тут взагалі дійти… проект геному людини, величезні досягнення в галузі науки про мозок, дослідження та колонізація космосу… привіт, люди, ми встигаємо за всім цим?

Тепер давайте повернемося до технологічних і наукових суперечок щодо таких пандемій, як COVID, і давайте не будемо зупинятися на цьому, а перейдемо до розгляду ситуації з широко доступною ядерною зброєю в руках корумпованих і некомпетентних так званих урядів, якими керують старіючі бюрократи, і політики взаємно гарантованого знищення.

Чи встигаємо ми за цим? Ні, але це лайно не відстає від нас, і воно має наш номер. Щоранку я прокидаюся і читаю про проксі-війну між НАТО та Росією, яка трагічно вбиває бідних людей, що живуть в Україні. І щоранку я думаю, чи це той день, коли некомпетентність наших так званих лідерів спричинить початок ядерної війни – щодня я думаю, чи це останній день для життя людини на планеті Земля.

Зараз спекотне літо 2023 року. Вийшов новий фільм під назвою «Оппенгеймер» про вченого, чия робота призвела до неймовірного жаху миттєвого вбивства сотень тисяч людей у Хіросімі та Нагасакі в Японії в 1945 році. Я не думаю будь-хто з нас ще спромігся розширити власну свідомість настільки, щоб зрозуміти абсолютне зло, шокуючу, нестерпну правду про помилки, яких припустилися наші суспільства, і про нашу неспроможність удосконалити себе та піднятися з нашої жалюгідної, ганебної суспільної пристрасті до масова ненависть і масове насильство.

Я згадував вище, що деякі люди запитують, чи може штучний інтелект призвести до свідомості та/або почуття – чи може система ШІ коли-небудь розвивати емоції та почуття, і що взагалі означають ці слова та ці запитання. Я ще не бачив фільм «Оппенгеймер», і мене дуже нудить від ідеї фільму про масові вбивства в Японії, де не показано облич японських жертв. Замість того, щоб задаватися питанням про те, чи розумні системи штучного інтелекту чи ні, я хочу лише сказати, що кожна людина, спалена в Хіросімі та Нагасакі, була розумною та свідомою. Це правда, з якою я не думаю, що нам ще вдалося поглянути в очі. Можливо, нам потрібно ще трохи потренувати свій розум на цьому.

І на цьому ми закінчуємо сьогодні. Люди не можуть впоратися з правдою про проблеми, які ми створили, і зміни, які ми повинні зробити, щоб покращити себе. Боти теж не впораються з правдою. Дякую, що поділилися зі мною цим місцем, коли я розмірковую над таємницями й іронією людського існування, і я збираюся розповісти нам про людський голос співачки та автора пісень, яку я люблю протягом тривалого часу, Шинейд О’Коннор, і пісня під назвою «Кімната зцілення». Дякую, що прослухали 50 серію. Незабаром повернемося до 51.

World BEYOND War Подкаст на iTunes

World BEYOND War Подкаст у Spotify

World BEYOND War Подкаст на Stitcher

World BEYOND War Подкаст RSS-канал